摘要gydF4y2Ba

地震信号检测和地震相位提取是噪声数据处理和微震监测中具有挑战性的任务。在这里,我们提出了一个同时进行地震检测和相位选择的全局深度学习模型。串联执行这两项相关任务,通过使用分层注意机制将阶段信息和地震信号的完整波形结合起来,提高了模型在每个单独任务中的性能。我们表明,我们的模型优于以前的深度学习和传统的相位选择和检测算法。将我们的模型应用于2000年日本鸟取地震期间连续5周的记录数据,我们仅使用一部分(不到1/3)地震台站就能探测和定位两倍多的地震。我们的模型选择P和S阶段的精度接近人工分析师的人工选择;然而,它的高效率和更高的灵敏度可以检测和表征更多和更小的事件。gydF4y2Ba

简介gydF4y2Ba

深度学习是一种应用广泛的有效方法,具有广泛的应用范围gydF4y2Ba1gydF4y2Ba.地震监测越来越需要更有效和更健壮的工具来处理越来越大的数据量,在概念上简单明了,并且有大量可用的标记数据,这使得地震检测和相位选择成为地震学中机器学习应用新浪潮的有吸引力的目标。迄今为止,地震信号检测和相位拾取是这个相对年轻的子领域的最大组成部分gydF4y2Ba2gydF4y2Ba,gydF4y2Ba3.gydF4y2Ba,gydF4y2Ba4gydF4y2Ba,gydF4y2Ba5gydF4y2Ba,gydF4y2Ba6gydF4y2Ba,gydF4y2Ba7gydF4y2Ba,gydF4y2Ba8gydF4y2Ba,gydF4y2Ba9gydF4y2Ba,gydF4y2Ba10gydF4y2Ba.尽管这些研究在方法和结果上存在差异,但大多数研究都发现了基于深度学习的方法与传统方法相比的重要优势gydF4y2Ba11gydF4y2Ba,gydF4y2Ba12gydF4y2Ba.gydF4y2Ba

地震信号的检测和相位提取是地震监测中的难题。探测是指在地震传感器记录的各种非地震信号和噪声中识别地震信号。相位选择是测量地震信号中不同地震相位(p波和s波相位)的到达时间,用于估计地震的位置。虽然这两项任务有一些相似之处,但它们的目标并不完全相同。尽量减少误报率和误报率是检测的主要目标;然而,相位拾取的重点是提高到达时间拾取的时间精度。这是由于地震定位估计对地震到达时间测量的极端敏感性——在确定p波到达时0.01秒的误差可以转化为数十米的位置误差。尽管检测和拾取都可以被视为识别时间序列数据中的不同变化,但与探测相比,相位拾取是一个局部问题,后者使用更全面的完整波形视图,包括来自多个地震相位的信息,包括散射波。正因为如此,之前的机器学习研究使用单独的网络单独处理这些任务;然而,这些任务彼此密切相关。 In practice, analysts first look at the entire waveform on multiple stations to identify consistent elements of an earthquake signal (e.g. P, S, coda and surface waves) with a specific ordering (P-wave always arrives before S-wave, higher frequency body waves always precede dispersive surface waves etc.) to determine whether or not a signal is from an earthquake. Then they focus on each phase to pick the arrival times precisely. This practice indicates the interconnection of these two tasks and the importance of contextual information in earthquake signal modeling.

深度学习检测/挑选模型通过从高级表示中学习地震波形和地震相位的一般特征来工作。在这里,我们测试了这样一个假设,即通过在地震波形中结合上下文信息获得的更好的表示将导致更好的模型。我们的期望是,地震信号的所有部分并非都与特定的分类任务同等相关。因此,确定局部(特定相位到达附近的窄窗口)和全局(全波形)地震特征相互作用的相关剖面是有益的。我们通过整合注意力机制来实现这一点gydF4y2Ba13gydF4y2Ba进入我们的网络。神经网络中的注意机制受到人类视觉注意的启发。人类关注高分辨率图像的某个区域,同时感知周围低分辨率图像,然后随着时间的推移调整焦点。我们的模型通过两个级别的注意机制来模拟这一点,一个是在全局级别上识别输入时间序列中的地震信号,另一个是在局部级别上识别地震信号中的不同地震相位。gydF4y2Ba

我们引入了一种新的深度学习模型(EQTransformer)gydF4y2Ba脚注gydF4y2Ba1gydF4y2Ba),根据注意机制同时探测地震信号,并对局地震中距离(<300 km)记录的单站数据选取前P相位和前S相位。在这里,我们提出了我们的方法,并将其与多种深度学习和传统的拾取器和检测器的性能进行了比较。我们训练的模型应用于在日本记录的连续5周的波形。我们对探测到的地震进行定位,是为了证明该模型对其他地区的泛化,以及它改进震源表征的能力。gydF4y2Ba

结果gydF4y2Ba

网络体系结构gydF4y2Ba

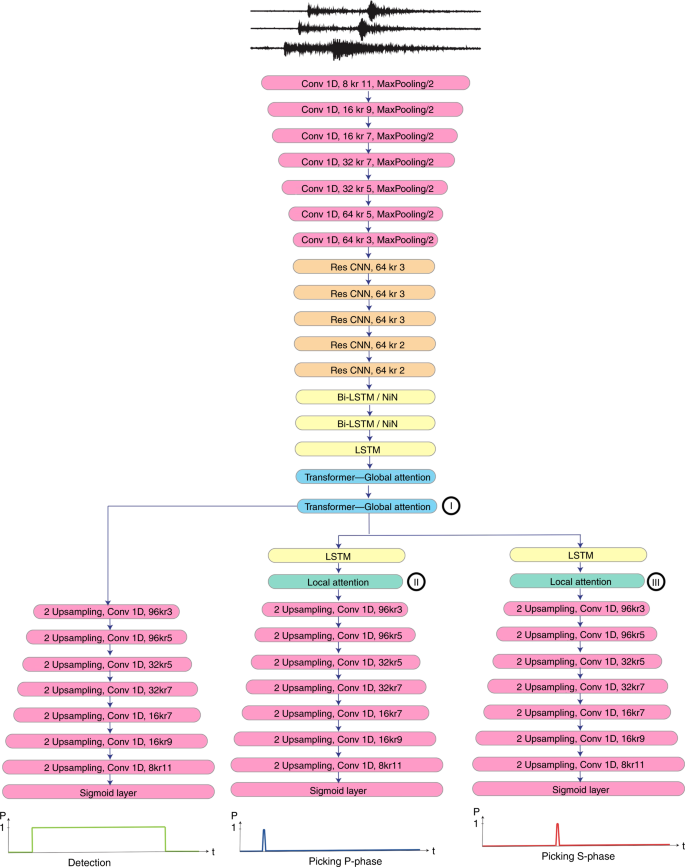

我们的神经网络有一个多任务结构,由一个非常深的编码器和三个独立的解码器组成,这些解码器由1D卷积、双向和单向长短期记忆(LSTM)、网络中网络、剩余连接、前馈层、变压器和自我注意层组成(图2)。gydF4y2Ba1gydF4y2Ba).方法部分提供了更多细节。编码器在时域内消耗地震信号,并生成关于它们的时间依赖性的高级表示和上下文信息。解码器然后使用这些信息将高级特征映射到三个相关的概率序列:地震信号的存在,p相位和s相位,对于每个时间点。gydF4y2Ba

在自我关注模型中,内存数量随序列长度而增长;因此,我们在编码器的前端添加了一个由卷积层和最大池化层组成的下采样部分。通过一系列残差卷积和LSTM块,将这些向下采样的特征转换为高级表示。编码器末端的全局注意部分旨在将网络的注意力引导到与地震信号相关的部分。然后,使用一个解码器分支,将这些高级特征直接映射到表示地震信号(探测)存在的概率向量。另外两个译码器分支分别与p相位和s相位相关联,其中LSTM/局部注意单元被放置在开始处。这种局部关注将进一步引导台网关注地震波形内与个别地震相关联的局部特征。每个块中的剩余连接和网络中的网络等技术有助于扩展网络的深度,同时保持错误率和训练速度可控。因此,我们有56层的深度网络只有大约372 K可训练参数。网络体系结构设计基于领域专业知识。 Optimization and hyperparameter selection are based on experiments on a large number of prototype networks.

数据和标签gydF4y2Ba

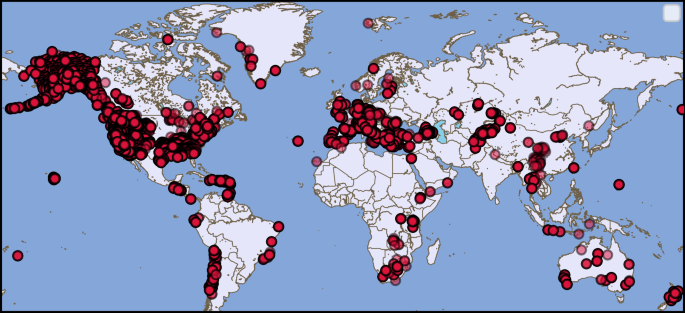

我们使用斯坦福地震数据集(STEAD)gydF4y2Ba13gydF4y2Ba训练网络。STEAD是一个大规模的全球标记地震和非地震信号数据集。在这里,我们使用了由震中距离达300公里的地震台记录的1m地震和300k噪声波形(包括环境噪声和文化噪声)。地震波形与地理分布不同的约450k次地震有关(图2)。gydF4y2Ba2gydF4y2Ba).这些地震大多小于2.5级,并且记录在距离震中100公里以内。数据集属性的完整描述可以在gydF4y2Ba13gydF4y2Ba.尽管STEAD包含了来自不同地理区域和构造环境的地震波形,但它没有任何来自日本的地震记录。我们将数据随机分为训练集(85%)、验证集(5%)和测试集(10%)。波形长度为1分钟,采样率为100 Hz,并从1.0-45.0 Hz进行带通滤波。采用盒形标签作为检测地真值。在这个二元向量中,P点到达到S点到达+ 1.4 × (S - P时间)的对应样本设为1,其余设为0。我们测试了三种不同的形式:方框、高斯和三角形,来标记相位到达。在我们的超参数选择过程中,三角形标记导致了更低的损失和更高的F-score,并被用于最终的模型。在这种形式中,P和S的概率在第一个到达P和S波时被设置为1,在每个相位到达前和到达后的20个样本内线性下降到0。gydF4y2Ba

培训gydF4y2Ba

对于卷积单元和LSTM单元,所有的权值和滤波器矩阵都用Xavier法向初始化器初始化gydF4y2Ba14gydF4y2Ba偏差向量设为0。我们使用ADAMgydF4y2Ba15gydF4y2Ba用不同的学习率进行优化,而在训练过程中学习率是不同的。该模型在tensorflow框架下使用4个并行Tesla-V100 gpu完成训练,耗时O(89)小时gydF4y2Ba16gydF4y2Ba.当连续12个周期验证损失没有改善时,训练停止。通过以下方法增强数据:在迹线的空部分添加二次地震信号,在地震波形中添加随机水平的高斯噪声,通过阵列旋转在迹线内随机移动事件,在噪声波形中随机添加间隙(短时间跨度归零),随机下降一个或两个通道(一个或两个通道的归零值),分别以0.3、0.5、0.99、0.2和0.3的概率。每批数据的一半是另一半波形的增强版本。在24个cpu上并行训练时,同时进行数据增强和归一化(通过标准偏差)。在训练和测试时,我们对所有的退出层都使用了0.1的退出率。gydF4y2Ba

探索网络的关注gydF4y2Ba

注意力权重定义了在预测每个输出时应该考虑多少每个输入状态,并可以解释为重要性权重向量。通过显式地可视化这些注意力权重,我们可以看到神经网络已经学会关注输入序列的哪些部分。gydF4y2Ba

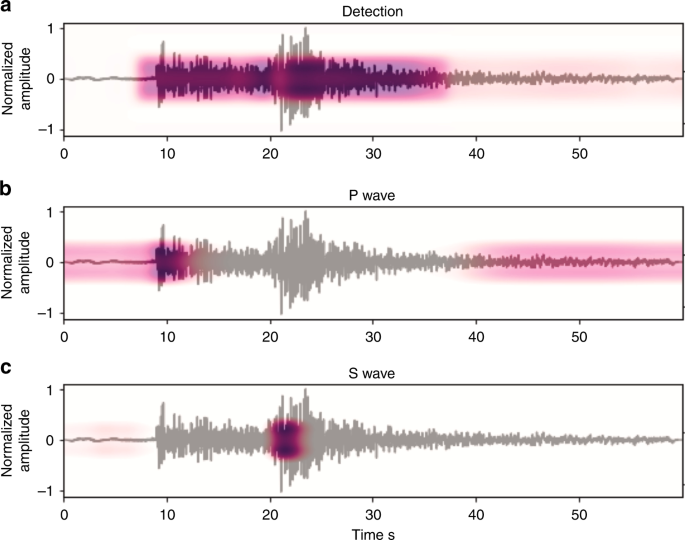

数字gydF4y2Ba3.gydF4y2Ba展示了评估集中一个特定事件的每个注意层的输出(所有其他时间步骤的隐藏状态的总和,由它们的得分加权)。我们可以看到,网络已经学会了在不同的注意力水平上关注波形的不同部分。这突出显示了每个任务的输入波形中最有用的部分。通过探测解码器的较短路径和较高的损失(由于标签长度较长)自然迫使网络首先学会在时间序列内区分地震信号。我们也可以从学习曲线中看到这一点(补充图。gydF4y2Ba2gydF4y2Ba).这模拟了地震分析师的决策流程。第二个变压器(I在图。gydF4y2Ba1gydF4y2Ba),在编码器段末端,主要将地震信号对应的信息传递给后续的解码器。这意味着编码器学会选择信号的哪些部分包含最重要的信息,用于检测和相位选择。探测解码器直接使用这些信息来预测时间序列中是否存在地震信号。P和S解码器开头的局部注意层进一步集中在地震波形内的较小部分,以进行预测。对齐分数是标准化的,可以认为是概率分布。所以我们可以将网络中的分层注意力机制解释为条件概率:gydF4y2BaPgydF4y2Ba(gydF4y2BaegydF4y2Ba一个gydF4y2BargydF4y2BatgydF4y2BahgydF4y2Ba问gydF4y2BaugydF4y2Ba一个gydF4y2BakgydF4y2BaegydF4y2Ba年代gydF4y2Ba我gydF4y2BaggydF4y2BangydF4y2Ba一个gydF4y2BalgydF4y2Ba∣gydF4y2Ba我gydF4y2BangydF4y2BapgydF4y2BaugydF4y2BatgydF4y2BawgydF4y2Ba一个gydF4y2BavgydF4y2BaegydF4y2BafgydF4y2BaogydF4y2BargydF4y2Ba米gydF4y2Ba) =gydF4y2BaegydF4y2BangydF4y2BacgydF4y2BaogydF4y2BadgydF4y2BaegydF4y2BargydF4y2Ba(gydF4y2Ba我gydF4y2BangydF4y2BapgydF4y2BaugydF4y2BatgydF4y2BawgydF4y2Ba一个gydF4y2BavgydF4y2BaegydF4y2BafgydF4y2BaogydF4y2BargydF4y2Ba米gydF4y2Ba),gydF4y2BaPgydF4y2Ba(gydF4y2BaPgydF4y2Ba_gydF4y2BapgydF4y2BahgydF4y2Ba一个gydF4y2Ba年代gydF4y2BaegydF4y2Ba∣gydF4y2Ba我gydF4y2BangydF4y2BapgydF4y2BaugydF4y2BatgydF4y2BawgydF4y2Ba一个gydF4y2BavgydF4y2BaegydF4y2BafgydF4y2BaogydF4y2BargydF4y2Ba米gydF4y2Ba) =gydF4y2BaPgydF4y2Ba_gydF4y2BadgydF4y2BaegydF4y2BacgydF4y2BaogydF4y2BadgydF4y2BaegydF4y2BargydF4y2Ba(gydF4y2BaPgydF4y2Ba(gydF4y2BaegydF4y2Ba一个gydF4y2BargydF4y2BatgydF4y2BahgydF4y2Ba问gydF4y2BaugydF4y2Ba一个gydF4y2BakgydF4y2BaegydF4y2Ba年代gydF4y2Ba我gydF4y2BaggydF4y2BangydF4y2Ba一个gydF4y2BalgydF4y2Ba∣gydF4y2Ba我gydF4y2BangydF4y2BapgydF4y2BaugydF4y2BatgydF4y2BawgydF4y2Ba一个gydF4y2BavgydF4y2BaegydF4y2BafgydF4y2BaogydF4y2BargydF4y2Ba米gydF4y2Ba))。gydF4y2Ba

输入波形被上下文信息覆盖-注意层的输出gydF4y2Ba一个gydF4y2Ba变压器(图1gydF4y2Ba1gydF4y2Ba),gydF4y2BabgydF4y2Ba局部注意p相(图1中的II),和gydF4y2BacgydF4y2Ba局部注意为s期(图1中的III)。gydF4y2Ba

结果及与其他方法的比较gydF4y2Ba

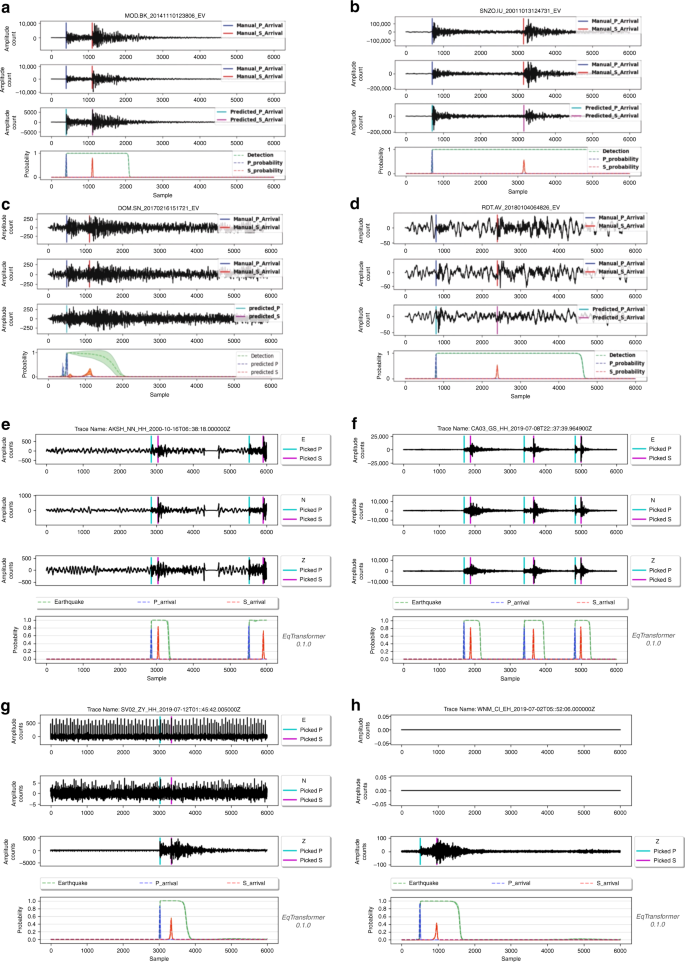

我们使用了超过113 k的测试波形(包括地震和噪声例子)来评估并比较EQTransformer与其他深度学习和传统方法的检测和拾取性能。这里用于比较的深度学习模型是基于不同训练集的预训练模型,所有模型都应用于STEAD的公共测试集。测试集数据包含1分钟长的3c波形。执行所有测试时,不会对测试数据进行额外的过滤。数字gydF4y2Ba4gydF4y2Ba说明了测试集中4个代表性样本的网络预测(图。gydF4y2Ba4gydF4y2Ba模拟)。该模型适用于不同波形的地震。该模型能够保持检测的全局视图,同时以高时间分辨率选择不同的到达时间。从图中的例子可以清楚地看出这一点。gydF4y2Ba4gydF4y2BaB,即检测到两个强烈且明显分离的波是单个事件的一部分,而不是两个单独的事件。网络的深度结构使其对噪声水平不那么敏感,对于具有高背景噪声的小事件也能很好地工作(图2)。gydF4y2Ba4gydF4y2Ba此外,即使输出概率很高,所提供的不确定性也可用于识别不可靠的预测(图。gydF4y2Ba4gydF4y2Bac)。gydF4y2Ba

四种代表性波形(gydF4y2Ba一个gydF4y2Ba- - - - - -gydF4y2BadgydF4y2Ba),以及将模型应用于日本鸟取连续数据的四种波形(gydF4y2BaegydF4y2Ba)及加州红冠(gydF4y2BafgydF4y2Ba- - - - - -gydF4y2BahgydF4y2Ba)展示模型在不同类型数据上的表现。每个波形长60秒,每秒100个采样,从1-45 Hz滤波。每个面板顶部显示三个通道波形,底部显示模型对地震信号检测、p到达和s到达的输出预测。在gydF4y2Ba一个gydF4y2Ba来gydF4y2BadgydF4y2Ba,前两个通道上用颜色编码的竖线是从目录中手动挑选到货时间。gydF4y2Ba一个gydF4y2Ba距离震中55公里的地方震级为2.2级,gydF4y2BabgydF4y2Ba在距离震中173公里的地方发生4.3级地震,gydF4y2BacgydF4y2Ba在距离震中38公里的地方有0.1级地震记录吗gydF4y2BadgydF4y2Ba在距离震中110公里的地方发生的震级为2.0级的地震。输出概率被表示为可以表示变化或模型不确定性的分布。gydF4y2BaegydF4y2Ba来gydF4y2BahgydF4y2Ba将模型应用于连续数据后检测到的事件,表示在1分钟窗口内存在多个事件时模型的性能(gydF4y2BaegydF4y2Ba而且gydF4y2BafgydF4y2Ba),当数据包含由0填充的空白时(gydF4y2BaegydF4y2Ba),当事件发生在边缘(gydF4y2BaegydF4y2Ba),当两个频道坏掉或有噪音时(gydF4y2BaggydF4y2Ba),或只存在一个组件数据时(gydF4y2BahgydF4y2Ba).gydF4y2Ba

我们还将该模型应用于连续数据。在测试/预测之前需要做的唯一的再处理步骤是:填充空白,去除趋势,带通滤波,并将数据重新采样到100 Hz。增强只在训练过程中应用。经过预处理后,连续的数据可以被分割成1分钟的窗口(优先有部分重叠)。该模型可以应用于单个或批量的1分钟切片。规范化是在向模型提供数据的过程中完成的。数字gydF4y2Ba4gydF4y2Bae-h展示了将模型应用于加利福尼亚州里奇克莱斯特和日本鸟取县连续记录的数据的结果。gydF4y2Ba

在训练过程中使用的增强对最终模型的性能至关重要。P个到达时间聚类在训练数据的第1 / 4个窗口,每个跟踪只包含1个事件。然而,无花果。gydF4y2Ba4gydF4y2BaE, f表明,无论训练集中存在这些特征,当1分钟窗口内和不同时间点存在多个事件时,模型都能很好地工作。该模型可以检测/挑选发生在边缘上的事件(图2)。gydF4y2Ba4gydF4y2Bae)只要P和s在窗口内存在0.2 s。由于填充连续数据中的空白,增强可以防止模型在突变时产生假阳性(图2)。gydF4y2Ba3.gydF4y2Bae).我们的模型适用于单通道数据(图;gydF4y2Ba3.gydF4y2Bah)或当其他信道中断或被噪声支配时(图。gydF4y2Ba3.gydF4y2Bag).补充材料中提供了更多模型在各种情况下的性能示例(补充图。gydF4y2Ba3.gydF4y2Ba- - - - - -gydF4y2Ba6gydF4y2Ba).gydF4y2Ba

我们用混淆矩阵表示测试集上的检测性能(补充图。gydF4y2Ba7gydF4y2Ba).我们的方法使用0.5的阈值,在113个K测试样本中仅产生1个假阳性和0个假阴性(没有遗漏事件)(补充图。gydF4y2Ba8gydF4y2Ba).为了比较性能,我们应用了三种深度学习(DetNetgydF4y2Ba5gydF4y2Ba,紫杉gydF4y2Ba4gydF4y2Ba,和CREDgydF4y2Ba7gydF4y2Ba)探测器和一个传统的(STA/LTAgydF4y2Ba11gydF4y2Ba)检测器到相同的测试集(表gydF4y2Ba1gydF4y2Ba).我们应该承认,每种方法(传统和深度学习检测器/拾取器)都涉及一定程度的调优,并且性能会根据这种调优而变化。我们提出的模型在f1得分方面优于其他方法。CRED还包含卷积和循环单元,并在相同的数据集(STEAD)上进行训练;但其性能没有达到EQTransformer的水平。这表明了合并注意机制和使用更深层次的网络进行地震信号检测的有益影响。DetNet训练的数据集比Yews小得多,但它有更好的性能;然而,DetNet和Yews在f得分方面都没有达到STA/LTA的结果,而且STA/LTA不需要训练。gydF4y2Ba

现在,我们将挑选性能与五种深度学习(PhaseNetgydF4y2Ba8gydF4y2Ba,加仑日gydF4y2Ba10gydF4y2Ba, PpkNetgydF4y2Ba5gydF4y2Ba,紫杉gydF4y2Ba4gydF4y2Ba, PickNetgydF4y2Ba2gydF4y2Ba)(补充图gydF4y2Ba9gydF4y2Ba)和三个传统的(峰度gydF4y2Ba17gydF4y2Ba, FilterPickergydF4y2Ba18gydF4y2Ba,以及AICgydF4y2Ba19gydF4y2Ba)(补充图gydF4y2Ba10gydF4y2Ba)自动拾取器。我们没有为第2节中提到的其他深度学习选择器找到一个文档良好的代码或训练有素的模型。这些是基于不同大小和不同区域的数据集预训练的模型,以评估其泛化性。这些训练集的列表在表中给出gydF4y2Ba2gydF4y2Ba而且gydF4y2Ba3.gydF4y2BaP和S选择。我们使用7个分数(误差标准差、平均误差、精密度、召回率、F1-score、平均绝对误差和平均绝对百分比误差)来评估每个拾取器的性能。当一个镐头与地面的绝对距离小于0.5秒时,它被认为是一个真正的正面。EQTransformer提高了P和S拾取的f值。p波选择比s波选择的改善更显著。这可能是因为选择s波更困难,容易产生更多错误,这可能导致训练集中的标记错误更高。一些深度学习拾取器的误差分布不均匀,可能由于它们的移动窗口方案而在零星时间聚集。所有这些模型(GPDgydF4y2Ba10gydF4y2Ba, PpkNetgydF4y2Ba5gydF4y2Ba,和紫杉gydF4y2Ba4gydF4y2Ba)使用比其他模型更宽的标签(PhaseNetgydF4y2Ba8gydF4y2Ba, PickNetgydF4y2Ba2gydF4y2Ba,和EQTransformer)。但是,很难找出它们的非正态误差分布背后的确切原因。gydF4y2Ba

适用于其他地区gydF4y2Ba

STEAD,用于我们模型训练的数据集,不包含来自日本的任何波形数据。这使得日本成为测试我们模型的性能和泛化的理想场所。我们选取2000 M的余震区gydF4y2BawgydF4y2Ba此次测试为鸟取西部6.6级地震。我们的探测器/相位选择器模型应用于2000年10月6日至11月17日18个HiNet站的连续数据。这些是日本气象厅(JMA)最初用于研究这一序列的气象站(57个)的一部分。EQTransformer代码中的预测模块在一段时间内至少存在一个概率高于指定阈值的相位(P或S),且大概率为地震时输出结果。在这里,我们分别使用阈值0.5、0.3和0.3进行检测、p拾取和s拾取。在预处理过程中使用500批和30%重叠。我们将阶段选择与基于检测时间的单个事件相关联。HypoinversegydF4y2Ba20.gydF4y2Ba和HypoDDgydF4y2Ba21gydF4y2Ba用于定位和重新定位相关事件。移动时差和互相关均用于重新定位。gydF4y2Ba

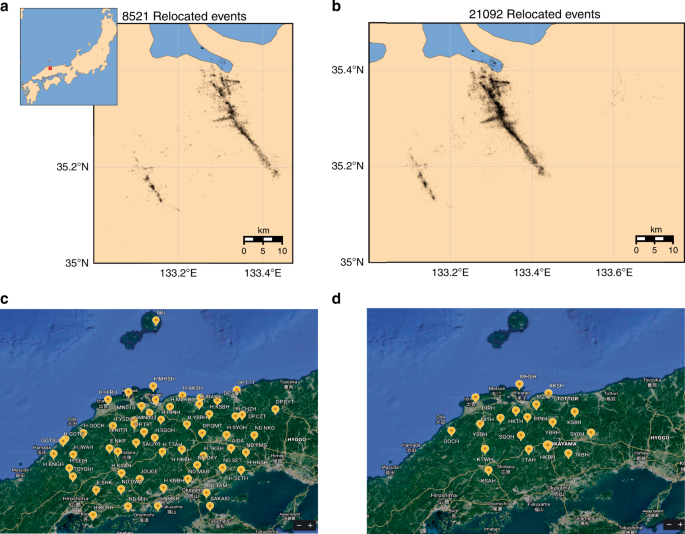

在这段时间内,我们检测并定位了21092个事件。gydF4y2Ba5gydF4y2Ba).与福山等人相比,这是事件数量的2倍多。gydF4y2Ba22gydF4y2Ba他们根据日本气象厅提供的精心挑选的阶段,在同一时期内重新安排了8521个活动。我们的目录几乎包括了日本气象台报道的所有事件。我们还注意到,我们的结果只使用了福山等人使用的站点的一个子集。gydF4y2Ba22gydF4y2Ba.大约15%的相关事件没有出现在最终的目录中;然而,这可能是由于我们的关联方法过于简单,并且很难将它们分配为错误检测。gydF4y2Ba

2000年10月6日至11月17日鸟取地区的地震活动。gydF4y2Ba一个gydF4y2Ba福山等人的搬迁事件。gydF4y2Ba22gydF4y2Ba使用JMA手动相位选择器。gydF4y2BabgydF4y2Ba使用本研究的自动相位选择器(EQTransformer)重新定位事件。gydF4y2BacgydF4y2Ba日本气象厅和福山等使用的57个地震台站的分布。gydF4y2Ba22gydF4y2BadgydF4y2Ba本研究中用于鸟取地区地震探测和定位的18个台站的分布。gydF4y2Ba

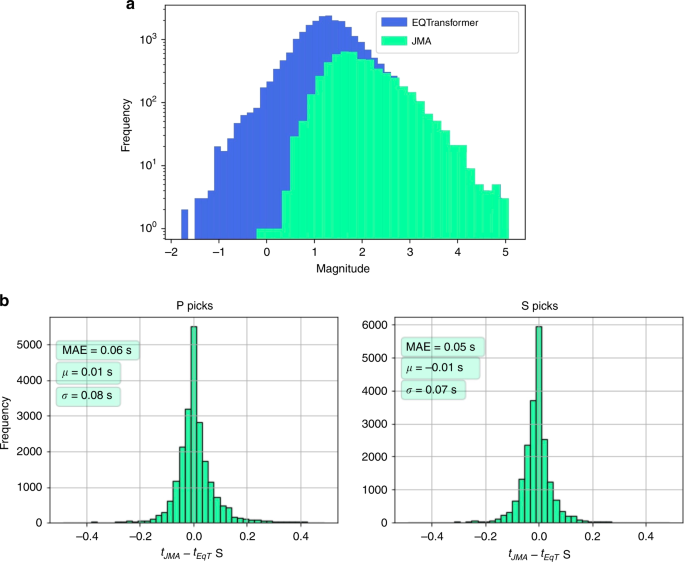

我们使用了局部大小关系gydF4y2Ba23gydF4y2Ba使用日本气象厅报告的震级校准到重新定位事件的估计震级。在我们的目录中,大多数新探测和定位的事件都是较小的地震——具有更嘈杂的波形——与JMA以前报告的地震相比(图2)。gydF4y2Ba6gydF4y2Baa).我们使用最大曲率方法估计JMA和我们的目录的完备度(Mc)分别为1.82和1.50gydF4y2Ba24gydF4y2Ba.而频幅分布结果(图;gydF4y2Ba6gydF4y2BaA)表明我们的深度学习方法在探测和表征小到20倍的微地震时是有效的,其他因素如更好的网络覆盖和更小的台站间距需要降低整体的完整性震级gydF4y2Ba25gydF4y2Ba,gydF4y2Ba26gydF4y2Ba.gydF4y2Ba

JMA的分析师总共在57个站点中选取了279,104个P和S到达时间,而EQTransformer能够在其中18个站点中选取401,566个P和S到达时间(由于无法获得其他站点的数据)。为了比较日本气象厅的人工检疫站和我们的自动检疫站,我们在普通车站使用了大约42,000个检疫站,并计算了到达时间的差异。P波和S波的人工拾取器和深度学习拾取器的到达时间差分布如图所示。gydF4y2Ba6gydF4y2Bab. pick之间的差值的标准差在0.08秒左右,平均绝对误差在0.06秒左右或6个样本。S选项的结果略好。平均误差只有1个样本(0.01 s)。gydF4y2Ba

讨论gydF4y2Ba

所提出的相位选择方法的更好性能可能是由于几个因素(例如,训练集的质量和数量、架构设计、注意机制、网络深度、训练过程中使用的增强等)。注意机制有助于在整个波形中纳入全局和局部尺度的特征。更深层次的网络可能通过学习更非线性的映射函数而产生更强的区分能力。gydF4y2Ba

基于我们的拾取器的测试集结果,错误似乎与噪声水平相关(补充图。gydF4y2Ba11gydF4y2Ba).在预测的变化和背景噪声水平之间也可以看到类似的相关性(补充图。gydF4y2Ba12gydF4y2Ba).我们没有发现估计的认知不确定性(输出概率的变化)和选择错误之间有明确的相关性。随机不确定性可能为选择置信区间提供更好的估计;然而,这种分类任务的随机不确定性估计是困难的gydF4y2Ba27gydF4y2Ba.即便如此,对于认知的不确定性和输出概率的可变性的了解对于降低假阳性率是有用的。gydF4y2Ba

补充图。gydF4y2Ba13gydF4y2Ba介绍了在德克萨斯州西部记录的导致假阳性的文化噪音的例子。这些到达的脉冲性质和频率范围使得很难将它们与地震波区分开来,特别是当使用到达附近的短窗口时。这可以预测P或S选择的高概率。然而,基于较长窗口的检测概率表现出较高的变化/不确定性,可用于消除虚假缺陷。将各种各样的人为和大气噪声纳入训练集将是减少误报的有效方法;然而,对这些噪音进行可靠的标记本身就是一项具有挑战性的任务。在训练过程中结合波形的光谱特征gydF4y2Ba7gydF4y2Ba也许还有别的办法。gydF4y2Ba

对于记录在更大震中距离的波形,选择P波往往更不确定(补充图。gydF4y2Ba12gydF4y2Ba).这些较高的不确定性可能是由于训练集中的长距离波形较少,而且当第一次到达的是紧急波或潜水波Pn时,P波可能更难挑选。数据的1.0 Hz高通滤波也会导致难以选择初始起始点。正如预期的那样,我们在选择较小的事件时观察到更高的不确定性(补充图。gydF4y2Ba12gydF4y2Ba).我们还注意到,较低的预测概率表现出较高的不确定性水平,并且对于较低信噪比、较大的事件站距离或较小的震级,模型输出较低的p波拾取概率。这种趋势对于s型选择并不强烈(补充图。gydF4y2Ba14gydF4y2Ba).gydF4y2Ba

地理位置和训练数据的大小似乎不是控制性能的主要因素。尽管PhaseNet只训练了来自北加州的数据,但它的性能非常好。这表明,由特定区域的数据集训练的深度学习模型可以很好地推广到其他区域,并且大多数目的的深度学习选择器可以直接使用,而无需重新训练。PpkNetgydF4y2Ba5gydF4y2Ba与使用更大的训练集构建的其他模型相比,用30 K波形训练的P波和S波的f得分更高。这表明其他因素,如网络类型(例如,循环vs卷积),训练过程(例如,增强的使用),或/和训练集的质量可能比训练集的大小发挥更重要的作用。gydF4y2Ba

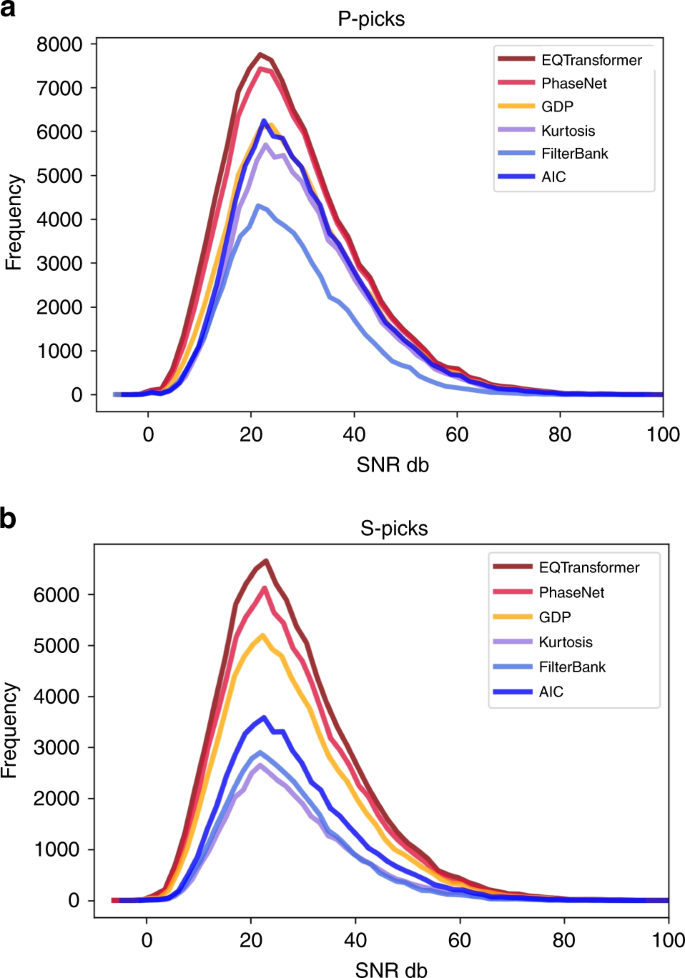

选择的精度似乎更受标签和训练程序的影响。例如,紫杉中p -pick的零星误差分布gydF4y2Ba4gydF4y2Ba,加仑日gydF4y2Ba10gydF4y2Ba和PpkNetgydF4y2Ba5gydF4y2Ba结果可能是由于他们的训练程序,使他们敏感的到达时间聚集在特定的时间点。与传统的拾取器相比,基于深度学习的方法对于噪声较大的波形表现更好,特别是对于S波(图2)。gydF4y2Ba7gydF4y2Ba).gydF4y2Ba

对具有不同性质的模型进行比较分析是一项非常具有挑战性的任务。不同的模型采用了不同的标签方法,并纳入了不同的网络设计。这导致了不同的超参数集,可以广泛地影响模型的性能。训练集的质量和训练程序是其他难以量化和衡量其影响的重要因素。另一方面,为比较建立一个公平的环境和使用可靠和独立的基准对于更加公正的评估是重要的。尽管存在这些缺陷,我们希望开始这样的努力,并鼓励我们在地震学界的同事进行更严格的测试和比较分析,从以前的尝试中学习和建立。gydF4y2Ba

传统的拾取器在到达时间拾取精度方面表现较好,但其主要缺点一般是召回率较低,在S阶段拾取性能较差(表2)gydF4y2Ba2gydF4y2Ba而且gydF4y2Ba3.gydF4y2Ba).传统拾取器的非对称误差分布(补充图。gydF4y2Ba9gydF4y2Ba而且gydF4y2Ba10gydF4y2Ba),主要是由于它们在选择到达时间时的系统延迟所引入的偏斜,这对S波更为显著;然而,它们与一些深度学习模型的可比性能表明了它们的有效性,即使它们不需要训练。我们还注意到传统的拾取器不一定更快。例如,在一台具有2.7 GHz英特尔酷睿i7处理器和16gb内存的机器上,它需要62小时12分钟、3小时25分钟和31小时18分钟来处理峭度、FilterPicker和AIC拾取器(基于PhasePApy中的python实现)gydF4y2Ba28gydF4y2Ba)分别选取整个测试集,而EQTransformer在2小时28分钟内(同一台机器上)完成检测/选取。gydF4y2Ba

EQTransformer在日本数据上的应用表明,该模型具有较高的泛化性和准确性。EQTransformer的到达时间采集精度与人工采集相当,其更高的灵敏度导致检测到的事件数量增加了两倍以上。新发现的事件不仅限于鸟取层序中的两条主断裂活动,还包括大山东侧的稀疏地震活动。这一结果仅使用了部分地震台站(不到1/3),台站间距相对较大,采用了简单的关联方法hgydF4y2Ba29gydF4y2Ba)可能会进一步增加事件的数量。该方法的有效性及其高效率(在不确定性估计的情况下,单个CPU处理1个月连续数据的时间为23分钟)突出了所提出的方法在改进地震监测方面的潜力。gydF4y2Ba

本文提出了一种基于分层注意模型的多任务网络同时进行地震探测和相位选取。我们的网络由一个深层编码器和三个独立的解码器组成。两个层次的自我关注(全局和局部)以分层结构嵌入到网络中,帮助神经网络捕获和利用地震波形中局部和全局特征之间的依赖关系。该模型具有几个显著的特点:(1)它是第一个地震信号的分层关注模型;(2) 56层激活层,是地震信号处理训练过最深的网络;(3)多任务体系结构,同时执行检测和相位选择,并通过层次结构对这些任务之间的依赖关系进行建模;(4)除预测概率外,还提供了基于贝叶斯推断的输出变化;(5)它是第一个使用全球分布的1.2 M局地地震观测训练集训练的模型。gydF4y2Ba

方法gydF4y2Ba

相关工作gydF4y2Ba

Perol等人。gydF4y2Ba30.gydF4y2Ba使用8个卷积和一个全连接层的网络来检测和聚类基于三种分量波形的事件。他们使用俄克拉荷马州记录的2700次地震和70000次噪声波形来训练他们的网络,并在同一地区的209次地震和131000次噪声波形上进行了测试。他们主要将他们的方法与相似搜索方法进行了比较,并得出结论,深度神经网络可以在更少的计算时间内获得更好的性能。Wu等人。gydF4y2Ba31gydF4y2Ba应用由7个全卷积层组成的密集连接网络来检测不同大小的实验室地震(1000个样本)。罗斯等人。gydF4y2Ba10gydF4y2Ba训练了一个由4个卷积层和2个完全连接层组成的网络,使用南加州记录的450万张地震图来检测p波、s波和噪声的短窗口。他们将训练过的网络应用于加州孟买海滩的一个站点记录的24小时连续数据,以及日本多个站点记录的单个事件,并表明深度神经网络能够检测与用于训练的不同波形形状的事件,而不牺牲检测灵敏度。罗斯等人。gydF4y2Ba9gydF4y2Ba采用类似的方法(3个卷积和2个全连接层)来选取P个到达时间。朱和贝罗萨gydF4y2Ba8gydF4y2Ba使用U-Net,一种具有跳过连接的全卷积编码器-解码器网络,用于端到端选择P和S阶段。他们用780k的地震记录来训练他们的网络,并用在北加州记录的78k地震记录来测试它。穆萨维等人。gydF4y2Ba7gydF4y2Ba提出了一种由卷积、双向长短期记忆单元和全连通层组成的残差网络,用于时频域地震信号的检测。他们使用了来自北加州的500 K 3分量噪声和构造地震记录来训练网络,并通过将其应用于半合成数据和在阿肯色州中部一系列诱导地震活动期间记录的连续一个月的地震图来测试最终模型的性能。这项研究表明,基于深度学习的模型可以很好地概括不同构造环境下记录的具有本质不同特征的地震事件,即使在存在高背景噪声水平的情况下,也能以较低的计算成本获得较高的精度。Pardo等人。gydF4y2Ba6gydF4y2Ba还使用了来自北加州的~774 K地震图来训练他们的两级相位拾取器。他们首先使用卷积网络对阶段进行粗略分割,然后在第二阶段进行回归以选择到达时间。Zhou等。gydF4y2Ba5gydF4y2Ba(~136 K增强P和S波形)和Zhu等。gydF4y2Ba4gydF4y2Ba(~30 K)使用2007年中国四川汶川余震序列的地震数据来训练基于深倾的探测器和拾取者。而周等人。gydF4y2Ba5gydF4y2BaZhu等人分别使用8层卷积网络和两层双向门控循环单元组成的两个独立网络进行检测和拾取。gydF4y2Ba4gydF4y2Ba以递归的方式使用相同的网络(11个卷积层和1个全连接层)进行检测,并以更大的计算时间为代价。Dokht等人。gydF4y2Ba3.gydF4y2Ba训练了两个独立的网络,每个网络由4个卷积层和2个全连接层组成,用于检测和在时频域对P和S到达时间的粗略估计。他们使用在加拿大西部记录的~162 K波形进行训练。Wang等。gydF4y2Ba2gydF4y2Ba在修改VGG-16台网和日本~740 K地震记录的基础上,建立了两个单独的模型,分别选取P到达时间和S到达时间。他们的模型适用于大约以S相到达为中心的短时间窗口。这种定心是利用理论到达时间来完成的,在实践中,如果没有地震位置的信息,理论到达时间是未知的。gydF4y2Ba

这些研究不仅在网络架构和总体方法上有所不同,还采用了不同的数据预处理、增强技术,使用不同大小、震级范围、震中距离、事件类型、噪声水平、地理位置的数据集,并使用不同的矩阵报告结果(例如准确度、精密度、召回率、f1得分、平均精密度、命中率、绝对误差、拾取误差等),这使得很难确定相对性能。每种方法的优缺点。这阻碍了社区采用和构建最有效的方法。这部分是由于缺乏具有高质量标签的标准基准数据集来进行严格的比较。本研究中使用的数据集(斯坦福地震数据集gydF4y2Ba13gydF4y2Ba)是开发和比较局部地震探测和相位选择算法的候选标准基准。gydF4y2Ba

网络设计gydF4y2Ba

地震信号是连续的时间序列,由不同的局部(单个地震相位)和更多的全局(例如体波和表面波和散射波的包)特征组成。因此,在地震信号的端到端深度学习模型中,保留局部依赖项和全局依赖项之间的复杂交互是有用的。传统上,递归神经网络被用于这种序列建模;然而,持续时间相对较长的地震信号需要在循环层之前进行一些下采样,以控制计算复杂度。因此,循环层和卷积层的组合已被证明是地震信号序列建模的有效架构gydF4y2Ba7gydF4y2Ba.在我们之前工作的基础上gydF4y2Ba7gydF4y2Ba,我们引入了一个包含循环层和卷积层的多任务网络,并将注意力机制纳入其中。注意机制是一种编码序列数据的方法,其中序列中的元素将根据其与任务的重要性或不相关性突出显示或降低权重gydF4y2Ba32gydF4y2Ba,gydF4y2Ba33gydF4y2Ba,gydF4y2Ba34gydF4y2Ba,gydF4y2Ba35gydF4y2Ba.我们的网络的整体结构包括一个编码器和三个独立的解码器。编码器在时域内消耗地震信号,并生成关于它们的时间依赖性的高级表示和上下文信息。解码器然后使用这些信息将高级特征映射到三个相关的概率序列:地震信号、p相位和s相位的存在。gydF4y2Ba

极深编码器gydF4y2Ba

几项研究gydF4y2Ba36gydF4y2Ba,gydF4y2Ba37gydF4y2Ba,gydF4y2Ba38gydF4y2Ba已经从原始波形的端到端学习中表明,采用更深层次的网络可以有利于具有更强的表达能力、更好的泛化和对波形中的噪声更强的鲁棒性。我们构建了一个非常深的编码器,这对于具有注意力的序列到序列模型的性能非常重要。gydF4y2Ba

在自注意模型中,记忆量随着序列长度的增加而增加。因此,我们在编码器的前端添加了一个由卷积层和最大池化层组成的下采样部分。编码器后面有几个剩余卷积层块和循环块,包括网络中的网络连接。gydF4y2Ba

卷积层利用局部结构,并为模型提供更好的时不变性,因此通常会产生更好的泛化。为了能够在不退化的情况下扩展网络深度,我们使用了带有剩余连接的卷积层块gydF4y2Ba39gydF4y2Ba如所述gydF4y2Ba39gydF4y2Ba(补充图。gydF4y2Ba15gydF4y2Ba).gydF4y2Ba

长短期记忆(LSTM)gydF4y2Ba40gydF4y2Ba是特定类型的循环神经网络,通常用于建模较长的序列。LSTM单元的主要部件是存储单元。在每个时间步,LSTM单元接收一个输入,输出一个隐藏状态,并根据门机制更新存储单元。在这里,我们通过包含网络中的网络来扩展双向LSTM块gydF4y2Ba41gydF4y2Ba模块,以帮助增加网络的深度,而不增加可学习参数的数量(补充图。gydF4y2Ba16gydF4y2Ba).LSTM层先于自我注意层,已被证明是合并位置信息所必需的gydF4y2Ba42gydF4y2Ba,gydF4y2Ba43gydF4y2Ba,gydF4y2Ba44gydF4y2Ba.gydF4y2Ba

注意机制gydF4y2Ba

我们用表示LSTM层的输出gydF4y2Ba\ (H = \ {{H} _ {t} \} \在{{\ mathbb {R}}} ^ {n \ * {d} _ {H}} \)gydF4y2Ba作为向量元素序列(原始输入信号的高级表示),其中:gydF4y2BangydF4y2Ba序列长度和gydF4y2BadgydF4y2BahgydF4y2Ba是表示的维数。我们计算自我(内部)注意如下gydF4y2Ba45gydF4y2Ba,gydF4y2Ba46gydF4y2Ba:gydF4y2Ba

在哪里gydF4y2BahgydF4y2BatgydF4y2Ba而且gydF4y2Ba\ ({h} _ {t ^ {\ '}} \)gydF4y2Ba隐状态表示是时间步长吗gydF4y2BatgydF4y2Ba而且gydF4y2Ba\ (t ^ {\ '} \)gydF4y2Ba分别。gydF4y2BaWgydF4y2Ba而且gydF4y2BabgydF4y2Ba分别为权重矩阵和偏差向量。gydF4y2BaσgydF4y2Ba是逐元素的sigmoid函数。gydF4y2Ba\({\alpha}_{t,t^{\prime}}\)gydF4y2Ba是标量分数(也称为对齐),表示序列元素之间的成对相似性。细心的隐藏状态表示,gydF4y2BacgydF4y2BatgydF4y2Ba,时间步长gydF4y2BatgydF4y2Ba由所有其他时间步上的隐状态之和给出,gydF4y2Ba\ ({h} _ {t ^ {\ '}} \)gydF4y2Ba,根据它们与当前隐藏状态的相似性进行加权,gydF4y2Ba\({\alpha}_{t,t^{\prime}}\)gydF4y2Ba.向量gydF4y2Ba\ ({c} _ {t} \在{{\ mathbb {R}}} ^ {{d} _ {h}} \)gydF4y2Ba是一个上下文感知的编码序列(相对于周围的元素),它定义了在每个时间步骤中,基于它们的邻域上下文将给予特性多少关注。这将被合并到下游任务中,作为额外的上下文信息,将注意力引导到序列的重要部分,并丢弃不相关的部分。gydF4y2Ba

我们采用了变压器中引入的剩余注意块gydF4y2Ba47gydF4y2Ba,gydF4y2Ba48gydF4y2Ba.我们将多头标度点积注意替换为上述单头加性注意(补充图。gydF4y2Ba17gydF4y2Ba).前馈层包括两个线性转换,中间有一个ReLU激活,gydF4y2Ba\ (FF (x) = \ max (0, x \ {W} _ {1} + {b} _ {1}) {W} _ {2} + {b} _ {2} \)gydF4y2Ba,旨在引入额外的非线性。gydF4y2Ba

我们的目标是在一个层次结构中实现两个层次的注意机制gydF4y2Ba46gydF4y2Ba,gydF4y2Ba49gydF4y2Ba,gydF4y2Ba50gydF4y2Ba在地震全波形和个别相位水平上。一种合乎逻辑的方法是在两个具有不同时间分辨率的级别上执行注意机制,例如:将检测注意应用于编码器末端的高级别表示,并将相位注意应用于相关解码器的末端,在那里可以获得更高的时间分辨率。与gydF4y2BaOgydF4y2Ba(gydF4y2BangydF4y2Ba2gydF4y2Ba.gydF4y2BadgydF4y2Ba)的自我注意的复杂性,然而,这是不可计算的长持续时间序列(6000个样本)在这里使用。因此,我们在瓶颈处应用了全局和局部注意力的注意机制。编码器末端的注意块通过关注序列中的所有位置来执行全局注意,以学习识别输入时间序列中的地震信号。从这一层到检测编码器的短路径和自然较高的检测损耗使这种学习更容易。gydF4y2Ba

相位拾取器解码器开头的注意块通过只关注序列的一个小子集来执行额外的局部注意gydF4y2Ba45gydF4y2Ba-旨在将焦点集中到地震波形内的个别地震相。在每层的第一个注意块之前应用一个16个单元的LSTM层提供位置信息gydF4y2Ba42gydF4y2Ba,gydF4y2Ba51gydF4y2Ba.gydF4y2Ba

估计的不确定性gydF4y2Ba

模型不确定性在应用深度学习和地震监测中具有重要意义;然而,以往用于地震探测/相位选择的深度学习模型都没有提供带有模型不确定性度量的概率输出。这些模型提供的预测概率并不等同于模型置信度。即使具有较高的软最大输出,模型的预测也可能是不确定的gydF4y2Ba52gydF4y2Ba.gydF4y2Ba

在深度学习中,模型的不确定性通常是通过推断网络权重的分布来估计的。由于计算的复杂性,这是通过使用推理技术逼近模型后验来完成的。Gal和GhahramanigydF4y2Ba52gydF4y2Ba显示了辍学生gydF4y2Ba53gydF4y2Ba,一种通常用于防止过拟合的技术,可用于在网络的权重上近似贝叶斯推理。这是通过在测试时使用dropout对网络的权重施加伯努利分布来实现的。这相当于从模型的后验分布中进行蒙特卡罗抽样。我们在神经网络的每一层之后都实现了dropout,并在训练和预测中使用它。gydF4y2Ba

数据可用性gydF4y2Ba

用于训练、验证和测试的斯坦福地震数据集(STEAD)可在:gydF4y2Bahttps://github.com/smousavi05/STEADgydF4y2Ba.龙鸟地区的连续数据从HiNet (gydF4y2Bahttp://www.hinet.bosai.go.jp/about_data/?LANG=engydF4y2Ba).本文中的地图和图形是使用通用映射工具和Matplotlib生成的gydF4y2Ba54gydF4y2Ba.在补充材料中提供了我们研究中发现和转移的所有事件的目录。本文提供了原始数据。gydF4y2Ba

代码的可用性gydF4y2Ba

我们的源代码和模型可在gydF4y2Bahttps://github.com/smousavi05/EQTransformergydF4y2Ba并可用于将模型应用于连续数据或再现论文中给出的结果。gydF4y2Ba

笔记gydF4y2Ba

-

我们的源代码和模型可在gydF4y2Bahttps://github.com/smousavi05/EQTransformergydF4y2Ba

参考文献gydF4y2Ba

LeCun, Y., Bengio, Y. & Hinton, G.深度学习。gydF4y2Ba自然gydF4y2Ba521gydF4y2Ba, 436(2015)。gydF4y2Ba

王杰,肖震,刘超,赵东,姚震。地震到达时间选择的深度学习方法。gydF4y2Baj .地球物理学。ResgydF4y2Ba.gydF4y2Ba124gydF4y2Ba, 6612-6624(2019)。gydF4y2Ba

Dokht, R. M., Kao, H., Visser, R. & Smith, B.使用时频表示和卷积神经网络的地震事件和相位检测。gydF4y2BaSeismol。卷。gydF4y2Ba90gydF4y2Ba, 481-490(2019)。gydF4y2Ba

朱,L.等。深度学习在2008 Mw7余震区地震相位检测与拾取中的应用。9 .汶川地震。gydF4y2Ba理论物理。地球的星球。内饰。gydF4y2Ba293gydF4y2Ba, 106261(2019)。gydF4y2Ba

周勇,岳海华,孔强,周森。基于卷积神经网络和递归神经网络的混合事件检测和相位提取算法。gydF4y2BaSeismol。卷。gydF4y2Ba90gydF4y2Ba, 1079-1087(2019)。gydF4y2Ba

Pardo, E., Garfias, C. & Malpica, N.,使用卷积网络的地震相位选择。gydF4y2BaIEEE反式。Geosci。遥感gydF4y2Ba57gydF4y2Ba, 7086-7092(2019)。gydF4y2Ba

朱伟,沈勇,朱伟。基于卷积和循环单元的深度残差网络地震信号检测。gydF4y2Ba科学。代表。gydF4y2Ba9gydF4y2Ba, 10267(2019)。gydF4y2Ba

朱,W. & Beroza, G. C.相位网:一种基于深度神经网络的地震到达时间提取方法。gydF4y2Ba地球物理学。j . Int。gydF4y2Ba216gydF4y2Ba, 261-273(2018)。gydF4y2Ba

罗斯,Z. E.,梅尔,m . a。& Hauksson, E. P波到达拾取和深度学习的第一运动极性确定。gydF4y2Baj .地球物理学。Res。gydF4y2Ba123gydF4y2Ba, 5120-5129(2018)。gydF4y2Ba

罗斯,Z. E.,梅尔,m . a。,Hauksson, E. & Heaton, T. H. Generalized seismic phase detection with deep learning.公牛。Seismol。Soc。点。gydF4y2Ba108gydF4y2Ba, 2894-2901(2018)。gydF4y2Ba

单迹自动地震识别和定时。gydF4y2Ba公牛。Seismol。Soc。点。gydF4y2Ba68gydF4y2Ba1521-1532(1978)。gydF4y2Ba

吉本斯,S. J. & Ringdal .使用阵列波形相关检测低震级地震事件。gydF4y2Ba地球物理学。j . Int。gydF4y2Ba165gydF4y2Ba, 149-166(2006)。gydF4y2Ba

穆萨维,盛永,朱伟,贝洛扎,郭志仁gydF4y2Ba斯坦福地震数据集(STEAD):人工智能地震信号的全球数据集gydF4y2Ba(IEEE 2019)。gydF4y2Ba

gloria, X. & Bengio, Y.理解训练深度前馈神经网络的难度。gydF4y2Baj·马赫。学习。Res。gydF4y2Ba9gydF4y2Ba, 249-256(2010)。gydF4y2Ba

金玛,D. P.和Ba . J.亚当:随机优化方法。预印在gydF4y2Bahttps://arxiv.org/pdf/1412.6980.pdfgydF4y2Ba(2014)。gydF4y2Ba

阿巴迪,等人。Tensorflow:用于大规模机器学习的系统。在gydF4y2Ba第十二届操作系统设计与实现研讨会gydF4y2Ba(16), 265-283(萨凡纳,2016)。gydF4y2Ba

Saragiotis, C. D., Hadjileontiadis, L. J. & Panas, S. M. pi - s /K:一个鲁棒自动地震P相位到达识别方案。gydF4y2BaIEEE反式。Geosci。远程Sens。gydF4y2Ba40gydF4y2Ba, 1395-1404(2002)。gydF4y2Ba

Lomax, A, Satriano, C. & Vassallo, M.自动拾取器的开发和优化:filterpicker -用于实时地震监测和地震早期预警的健壮的宽带拾取器。gydF4y2BaSeismol。卷。gydF4y2Ba83gydF4y2Ba, 531-540(2012)。gydF4y2Ba

在地震波数据自动处理系统中读取和检查相位时间的一种方法。gydF4y2BaZisingydF4y2Ba38gydF4y2Ba, 365-379(1985)。gydF4y2Ba

克莱因,F. W.用户指南HYPOINVERSE-2000, Fortran程序解决地震位置和震级4/2002版本。美国地质勘探局,开放文件报告02-171版本,1,123。(2002)。gydF4y2Ba

Waldhauser, F. & Ellsworth, W. L.一个双差分地震定位算法:方法和应用于北海沃德断层,加利福尼亚。gydF4y2Ba公牛。Seismol。Soc。点。gydF4y2Ba90gydF4y2Ba, 1353-1368(2000)。gydF4y2Ba

福山,E., Ellsworth, W. L., Waldhauser, F. & Kubo, A. 2000年日本鸟取西部地震序列的详细断层结构。gydF4y2Ba公牛。地震Soc。点。gydF4y2Ba93gydF4y2Ba, 1468-1478(2003)。gydF4y2Ba

Bakun, W. H. & Joyner, W. B.加州中部的ML量表。gydF4y2Ba公牛。地震Soc。点。gydF4y2Ba74gydF4y2Ba, 1827-1843(1984)。gydF4y2Ba

韦默,S. & Wyss, M.地震目录中最小完整震级:阿拉斯加、美国西部和日本的例子。gydF4y2Ba公牛。Seismol。Soc。点。gydF4y2Ba90gydF4y2Ba, 859-869(2000)。gydF4y2Ba

穆萨维,S. M.评论“中东目录的最新发展”由扎雷等人。gydF4y2Baj . Seismol。gydF4y2Ba21gydF4y2Ba, 257-268(2017)。gydF4y2Ba

伊朗高原大陆碰撞造山带区域的地震矩和b值映射。gydF4y2Baj .地球动力学gydF4y2Ba103gydF4y2Ba, 26-41(2017)。gydF4y2Ba

穆萨维,S. M. & Beroza, G. C.贝叶斯-深度学习估计地震位置从单站观测。gydF4y2BaIEEE。反式。Geosci。遥远。SensgydF4y2Ba.gydF4y2Bahttps://doi.org/10.1109/TGRS.2020.2988770gydF4y2Ba(2020)。gydF4y2Ba

Chen, C. & Holland, a . a . PhasePApy:一个健壮的纯Python包,用于自动识别地震相位。gydF4y2BaSeismol。卷。gydF4y2Ba87gydF4y2Ba, 1384-1396(2016)。gydF4y2Ba

耶克,W. L.等人。Glass3:一个独立的多尺度地震探测关联器。gydF4y2Ba公牛。Seismol。Soc。点。gydF4y2Ba109gydF4y2Ba, 1469-1478(2019)。gydF4y2Ba

Perol, T., Gharbi, M. & Denolle, M.用于地震检测和定位的卷积神经网络。gydF4y2Ba科学。睡觉。gydF4y2Ba4gydF4y2Ba, e1700578(2018)。gydF4y2Ba

吴,Y.等。DeepDetect:用于地震事件检测的级联区域密集连接网络。gydF4y2BaIEEE反式。Geosci。远程Sens。gydF4y2Ba57gydF4y2Ba, 62-75(2018)。gydF4y2Ba

自然语言处理问题中注意机制的概述。在gydF4y2BaSAI智能系统会议论文集gydF4y2Ba,第432-448页(施普林格,Cham, 2019)。gydF4y2Ba

Bahdanau, D., Cho, K. & Bengio, Y.通过联合学习对齐和翻译神经机器翻译。预印在gydF4y2Bahttps://arxiv.org/abs/1409.0473gydF4y2Ba(2014)。gydF4y2Ba

徐,K.等。展示、参与和讲述:视觉注意力的神经图像标题生成。在gydF4y2Ba机器学习国际会议gydF4y2Ba, 2048-2057(2015)。gydF4y2Ba

赫尔曼,K. M.等。教机器阅读和理解。在gydF4y2Ba神经信息处理系统研究进展gydF4y2Ba, 1693-1701(2015)。gydF4y2Ba

Zhang, Y., Chan, W. & Jaitly, N.,用于端到端语音识别的深度卷积网络。在gydF4y2Ba2017 IEEE声学、语音和信号处理国际会议(ICASSP)gydF4y2Ba, 4845-4849(2017)。gydF4y2Ba

Tan, T.等。自适应超深度卷积残差网络噪声鲁棒语音识别。gydF4y2BaIEEE / ACM反式。语音语音郎。的过程。gydF4y2Ba26gydF4y2Ba, 1393-1405(2018)。gydF4y2Ba

戴伟,戴超,曲生,李娟,戴超。基于原始波形的超深度卷积神经网络。在gydF4y2Ba2017 IEEE声学、语音和信号处理国际会议(ICASSP)gydF4y2Ba, 421-425(2017)。gydF4y2Ba

何凯,张晓霞,任松,孙娟。基于深度残差学习的图像识别方法。在gydF4y2BaIEEE计算机视觉与模式识别会议论文集gydF4y2Ba, 770-778(2016)。gydF4y2Ba

何克瑞特,史密德胡伯,J.长短期记忆。gydF4y2Ba神经第一版。gydF4y2Ba9gydF4y2Ba, 1735-1780(1997)。gydF4y2Ba

林,M,陈,q,严,s,网络中的网络。预印在gydF4y2Bahttps://arxiv.org/abs/1312.4400gydF4y2Ba(2013)。gydF4y2Ba

斯珀伯,M., Niehues, J., Neubig, G., Stüker, S. & Waibel, A.自注意声学模型。预印在gydF4y2Bahttps://arxiv.org/abs/1803.09519gydF4y2Ba(2018)。gydF4y2Ba

Chan, W., Jaitly, N., Le, Q.和Vinyals, O.听,参加和拼写:用于大词汇会话语音识别的神经网络。在gydF4y2Ba2016 IEEE声学、语音与信号处理国际会议(ICASSP)gydF4y2Ba, 4960-4964(2016)。gydF4y2Ba

杨志强,何晓霞,高俊,邓丽丽,杨志强。图像问答的层叠注意网络。在gydF4y2BaIEEE计算机视觉与模式识别会议论文集gydF4y2Ba, 21-29 (ieee, 2016)。gydF4y2Ba

陈德良M.-T。,Ph一个米,H. & Manning, C. D. Effective approaches to attention-based neural machine translation. Preprint athttps://arxiv.org/abs/1508.04025gydF4y2Ba(2015)。gydF4y2Ba

Yang, Z.,等。用于文档分类的分层注意网络。在gydF4y2Ba计算语言学协会北美分会2016年会议记录:人类语言技术gydF4y2Ba, 1480-1489(2016)。gydF4y2Ba

Vaswani, A.等人。你所需要的就是关注。在gydF4y2Ba神经信息处理系统研究进展gydF4y2Ba, 5998-6008(2017)。gydF4y2Ba

戴福林,张敏。,Lee, K. & Toutanova, K. Bert: Pre-training of deep bidirectional transformers for language understanding. Preprint athttps://arxiv.org/abs/1810.04805gydF4y2Ba(2018)。gydF4y2Ba

吉,J.等。语法纠错的嵌套注意神经混合模型。预印在gydF4y2Bahttps://arxiv.org/abs/1707.02026gydF4y2Ba(2017)。gydF4y2Ba

于,L., Bansal, M. & Berg, T. L.用于专辑摘要和讲故事的层次关注RNN。预印在gydF4y2Bahttps://arxiv.org/abs/1708.02977gydF4y2Ba(2017)。gydF4y2Ba

Mnih, V., Heess, N., Graves, A.等。视觉注意力的循环模型。在gydF4y2Ba神经信息处理系统研究进展gydF4y2Ba, 2204-2212(2014)。gydF4y2Ba

盖尔,Y. & Ghahramani, Z. Dropout作为贝叶斯近似:表示深度学习中的模型不确定性。在gydF4y2Ba机器学习国际会议gydF4y2Ba, 1050-1059(2016)。gydF4y2Ba

Srivastava, N., Hinton, G., Krizhevsky, A., Sutskever, I. & Salakhutdinov, R. Dropout:一种防止神经网络过拟合的简单方法。gydF4y2Baj·马赫。学习。Res。gydF4y2Ba15gydF4y2Ba1929-1958(2014)。gydF4y2Ba

亨特,J. D. Matplotlib:一个2D图形环境。gydF4y2Bahttps://doi.org/10.1109/MCSE.2007.55Comput.ScigydF4y2Ba(2007)。gydF4y2Ba

确认gydF4y2Ba

我们要感谢Yijian Zhou在我们的测试集上测试PpkNet模型。Eiichi fuyama, Kaz Imanishi, Shin Aoi, Takanori Matsuzawa帮助我们获得了鸟取序列的HiNet数据。S.M.M.由斯坦福诱发和触发地震活动中心(SCITS)支持,G.C.B.由AFRL支持,合同编号为FA9453-19-C-0073。gydF4y2Ba

作者信息gydF4y2Ba

作者及隶属关系gydF4y2Ba

贡献gydF4y2Ba

S.M.M.设计了这项研究,实施了方法,进行了测试并进行了分析。W.L.E.设计了鸟取测试,并帮助解释分析结果。W.Z.将相网应用于测试集。L.C.将紫杉应用于测试集并进行了一些分析。gcb领导了这个项目,并审阅了手稿。S.M.M.和G.C.B.写了手稿。所有作者都对结果进行了广泛的讨论。gydF4y2Ba

相应的作者gydF4y2Ba

道德声明gydF4y2Ba

相互竞争的利益gydF4y2Ba

作者声明没有利益竞争。gydF4y2Ba

额外的信息gydF4y2Ba

同行评审信息gydF4y2Ba自然通讯gydF4y2Ba感谢William Yeck、Alberto Michelini和Christopher Johnson对本工作的同行评审所作的贡献。同行评审报告是可用的。gydF4y2Ba

出版商的注意gydF4y2Ba施普林格自然对出版的地图和机构从属关系中的管辖权主张保持中立。gydF4y2Ba

源数据gydF4y2Ba

权利和权限gydF4y2Ba

开放获取gydF4y2Ba本文遵循知识共享署名4.0国际许可协议(Creative Commons Attribution 4.0 International License),允许以任何媒介或格式使用、分享、改编、分发和复制,只要您对原作者和来源给予适当的署名,提供知识共享许可协议的链接,并注明是否有更改。本文中的图像或其他第三方材料包含在文章的创作共用许可中,除非在材料的信用额度中另有说明。如果内容未包含在文章的创作共用许可协议中,并且您的预期使用不被法定法规所允许或超出了允许的使用范围,您将需要直接获得版权所有者的许可。要查看此许可证的副本,请访问gydF4y2Bahttp://creativecommons.org/licenses/by/4.0/gydF4y2Ba.gydF4y2Ba

关于本文gydF4y2Ba

引用本文gydF4y2Ba

穆萨维,s.m.,埃尔斯沃斯,w.l.,朱伟。gydF4y2Baet al。gydF4y2Ba地震变压器——一种同步地震探测和相位选择的深度学习模型。gydF4y2BaNat CommungydF4y2Ba11gydF4y2Ba, 3952(2020)。https://doi.org/10.1038/s41467-020-17591-wgydF4y2Ba

收到了gydF4y2Ba:gydF4y2Ba

接受gydF4y2Ba:gydF4y2Ba

发表gydF4y2Ba:gydF4y2Ba

DOIgydF4y2Ba:gydF4y2Bahttps://doi.org/10.1038/s41467-020-17591-wgydF4y2Ba

这篇文章被引用gydF4y2Ba

利用日本关东地区局部地震对深层地壳结构的地震反射成像gydF4y2Ba

《地球、行星与空间gydF4y2Ba(2023)gydF4y2Ba

一种改进卫星图像滑坡探测的U-Net模型gydF4y2Ba

摄影测量、遥感和地球信息科学杂志gydF4y2Ba(2023)gydF4y2Ba

使用1D和2D cnn识别地震事件:火山和构造数据集的应用gydF4y2Ba

《地球、行星与空间gydF4y2Ba(2022)gydF4y2Ba

深度压缩地震学习快速定位和矩张量推断与自然和诱发地震活动gydF4y2Ba

科学报告gydF4y2Ba(2022)gydF4y2Ba

基于物理的深度学习方法模拟地壳变形gydF4y2Ba

自然通讯gydF4y2Ba(2022)gydF4y2Ba

评论gydF4y2Ba

通过提交评论,您同意遵守我们的gydF4y2Ba条款gydF4y2Ba而且gydF4y2Ba社区指导原则gydF4y2Ba.如果您发现一些滥用或不符合我们的条款或指导方针,请标记为不适当。gydF4y2Ba