摘要

蚊子传播大量寄生虫和病原体,导致致命疾病。蚊种鉴定是有效控制蚊虫的先决条件。现有的形态学和分子分类方法存在不可避免的缺点。这里我们介绍了用于蚊子种类识别的深度学习技术。构建了覆盖17个物种的9900张原始图像的平衡、高清蚊子数据集。经过三轮筛选和调整测试(第一轮在3个卷积神经网络和3个Transformer模型之间,第二轮在3个Swin Transformer变体之间,第三轮在2个图像尺寸之间),我们提出了第一个基于Swin Transformer的蚊子物种识别模型(Swin MSI),准确率为99.04%,f1评分为99.16%。通过可视化的识别过程,Swin MSI中使用的形态键与人类使用的相似但不相同。Swin MSI在尖音库蚊新物种分类复杂,准确率为96.26%。为蚊虫鉴定和蚊媒疾病防治提供了一种有前景的方法。

简介

蚊子属于双翅目,传播多种寄生虫和病原体,每年在全世界造成数亿人感染,约75万人死亡1.因此,蚊子被认为是头号“动物杀手”,是医学上最重要的昆虫类群之一。不同种类的蚊子有不同的栖息地、生物习性和病原体负荷。例如,按蚊蚊子主要传播疟疾,全球每年估计有2.19亿例疟疾病例,40多万人死亡2,伊蚊蚊子传播登革热,每年约有9600万有症状的病例,威胁着129多个国家的39亿多人3., Zika病毒4和基孔肯雅热5.库蚊蚊子传播西尼罗河病毒6,日本脑炎病毒7还有淋巴丝虫病8.由于大多数蚊媒疾病没有特定的疫苗或药物,因此控制蚊虫仍然是预防和控制这些疾病的主要措施。查明现有蚊种是有效防控蚊媒疾病的前提和基础。只有准确识别蚊子种类,才能了解它们的繁殖特征和行为习惯,制定正确的预防策略,有针对性地采取措施,确保快速控制9,10,11.

目前蚊种鉴定方法主要依赖于蚊的形态特征;这些方法耗时,费力,易受遗传变异和表型可塑性相关的不确定性的影响12,13.即使是有经验的分类学家,也很难通过蚊群的外部形态特征来识别具有细微外部形态差异的蚊群。例如,亚种尖音库蚊复合体只能通过解剖男性生殖器来分类14,15.此外,分子鉴定方法虽然有效,但成本高,技术要求高。此外,这些传统的分类方法难以完全满足快速增长的对蚊子种类快速智能鉴定的需求。

随着计算能力的提高,大数据的爆炸式增长和机器学习算法的进步,深度学习技术得到了迅速发展,并开始应用于图像分类任务中。卷积神经网络(CNN)模型具有不同的结构(LeNet16, AlexNet17, GoogLeNet18, VGGNet19, ResNet20., SqueezeNet21等)已陆续应用于利用图像进行蚊虫自动识别。然而,由于这些网络的层结构存在缺陷,在每一层的计算中容易丢失特征,导致梯度消失或爆炸;因此,这些方法不能有效地捕捉像素点之间的关系。变压器模型最初应用于自然语言处理研究,通过其单层结构和多头自注意机制可以解决上述问题。因此,人们尝试将变压器模型应用于计算机视觉研究中,这些模型的效果可以媲美甚至超过cnn22,23,24.

本研究的主要贡献总结如下。(1)我们的目标是建立迄今为止最高清晰度和最平衡的蚊子图像数据集,包括17个物种和3个亚种,共计9900张图像,图像分辨率为4464 × 2976像素。该数据集的所有分类和识别特征都达到了人眼的识别能力。(2)建立了基于Swin transformer的蚊种鉴定模型(Swin MSI),蚊种和性别鉴定准确率为99.04% (F1-score 99.16%)。(3)在本研究所进行的试验集中,蚊类亚种和性别鉴定的准确率残雪。侵害形态上无法区分的复合体,都是100%。(4) Swin MSI模型可以识别出本研究数据集以外的新蚊,正确的属属归属准确率为96.26% (F1-score为98.09%)。(5)通过可视化识别过程,Swin MSI模型使用的形态键与人类使用的形态键相似,但不完全相同。

本研究提出的Swin MSI模型可以比以往建立的模型更准确地进行蚊子种类识别,有助于分类学家识别蚊子,实现对蚊子及其相关传播疾病的有效监测和预防。

结果

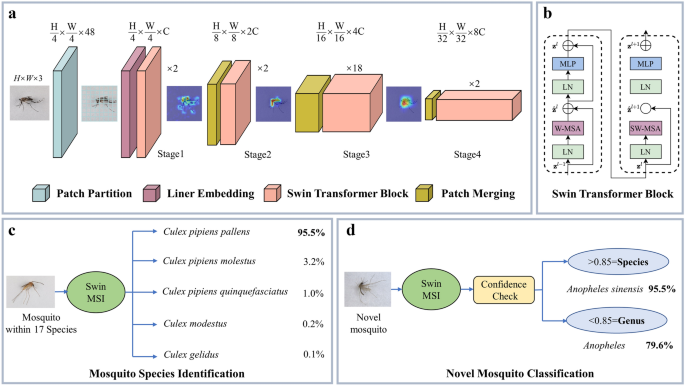

Swin MSI的框架

利用自构建的图像数据集和多次调整试验,建立了第一个基于Swin transformer的蚊种识别模型(Swin MSI)。使用梯度加权类激活映射来可视化识别过程(图2)。1a).关键的Swin Transformer块如图所示。1b.根据实际需要,增设Swin MSI,在亚种水平上对库蚊复合物进行鉴定(图。1c)和新型蚊子(在我们的数据集中定义为17种以上的蚊子)分类归因(图;1d).详细结果如下所示。

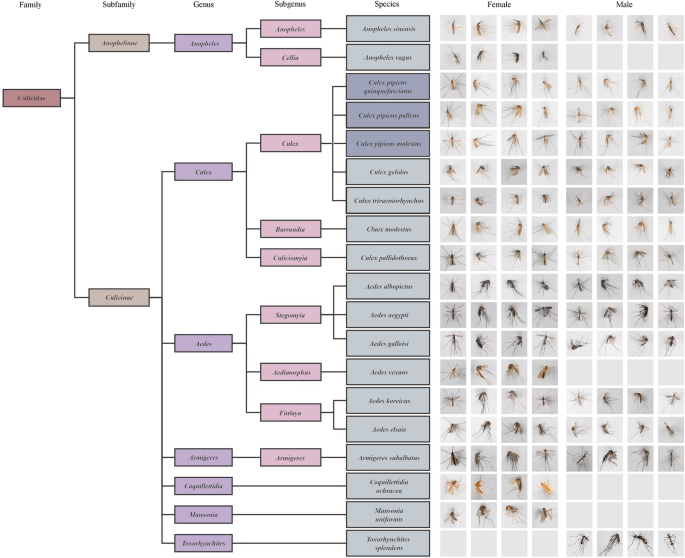

蚊子的数据集

我们建立了迄今为止最高清晰度和最平衡的蚊子图像数据集。蚊类图像集涵盖7属17种(包括3个形态相似的亚种)残雪。侵害其中涵盖了全球范围内最常见和最重要的传播疾病的蚊子,总共有9,900张蚊子图像。图像分辨率为4464 × 2976像素。具体的分类状态和对应的图像如图所示。2.由于野外采集的局限性,Ae。vexans,Coquillettidia ochracea,Mansonia均匀化,一个。迷走神经而且巨蚊splendens只有女性或者只有男性。此外,为了平衡训练集的容量和种类,每一种蚊子都包含了300张两性的图像,这对于每一种蚊子来说都足够大,数量相同。

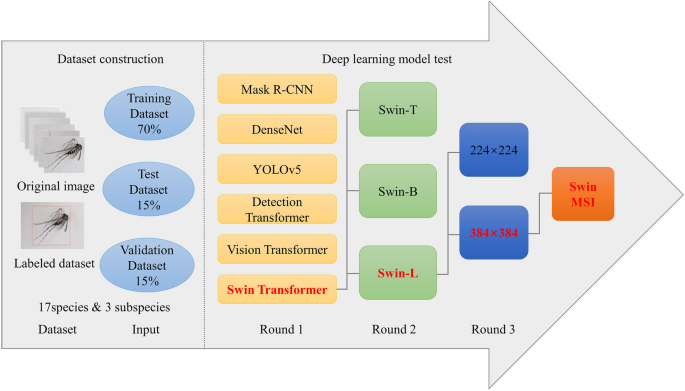

蚊种鉴定工作流程

采用构建最佳深度学习模型以识别蚊虫种类模型的三阶段流程图(图2)。3.).第一个学习阶段由三个cnn (Mask R-CNN、DenseNet和YOLOv5)和三个变压器模型(Detection transformer、Vision transformer和Swin transformer)进行。在第一阶段模型的性能和真实蚊子标签的基础上,第二阶段学习调整三种Swin Transformer变体(T, B, L)的模型参数,比较它们的性能。第三个学习阶段包括测试输入不同大小的图像(384 × 384和224 × 224)到Swin Transformer-L模型的效果;最后,我们提出了一种用于蚊子种类识别的深度学习模型(Swin MSI)来测试不同蚊子种类的识别效果。该模型在不同蚊种上进行了验证,重点研究了三种亚种的识别精度残雪。侵害新型蚊种的检测效果与复配。

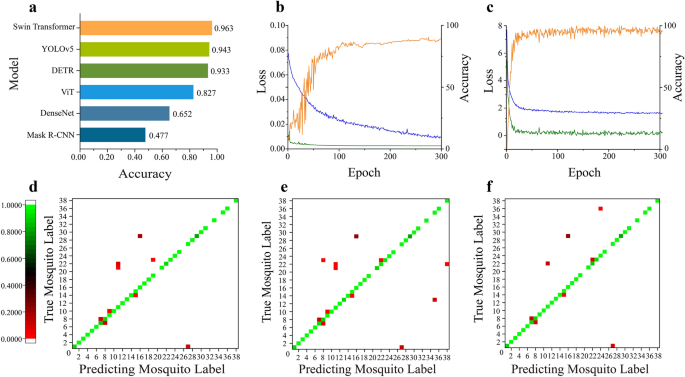

CNN模型与Transformer模型结果比较(第一轮学习)

数字4A显示了在蚊子图片测试集上测试的六种不同计算机视觉网络模型所获得的准确性。实验结果表明,变压器网络模型比CNN具有更高的蚊虫种类识别能力。

计算机视觉网络模型与变异体蚊虫识别效果比较。(一个) 3个cnn与3个Transformer蚊虫识别准确率的比较;(b)最佳效果CNN (YOLOv5)训练集损失曲线(蓝色)、验证集损失曲线(绿色)和验证集精度曲线(橙色);(c)最佳效果变压器(Swin Transformer)训练集损耗曲线、验证集损耗曲线和验证集精度曲线。(d) Swin-MSI-T测试结果混淆矩阵;(e) Swin-MSI -B测试结果混淆矩阵;(f) Swin-MSI -L测试结果混淆矩阵。蚊子标签的混淆矩阵,其中奇数代表雌性,偶数代表雄性。混淆矩阵中的小方块表示识别就绪率,从红色到绿色,识别就绪率越来越高一个。中国: 1、2;残雪。这种致倦侵害: 3,4;残雪。侵害pallens: 5,6;残雪。侵害molestus: 7、8残雪。modestus: 9、10;Ae。蚊: 11、12Ae。蚊: 13,14;残雪。pallidothorax: 15,16Ae。galloisi: 17日18Ae。vexans: 19,20;Ae。koreicus: 21、22骑士的扈从subalbatus: 23, 24;Coquillettidia ochracea: 25,26残雪。gelidus: 27,28残雪。triraeniorhynchus: 29、30Mansonia均匀化: 31,32一个。迷走神经: 33,34Ae。elsaie: 35、36巨蚊splendens: 37, 38。

在CNN训练过程中(应用于YOLOv5),验证精度需要超过110个epoch才能增长到0.9,验证损失需要110个epoch才能下降到平坦区间;相比之下,在训练步骤中,这些损失是一个不断减少的过程。这些结果表明,基于Swin Transformer算法推导出的深度学习模型在迭代过程中比CNN的快速收敛能力在更短的时间内获得更高的识别精度(图2)。4b)。

Swin Transformer模型的测试精度最高,达到96.3%。在训练过程中,该模型的损失在30个epoch后趋于稳定,在20个epoch后验证精度提高到0.9;在验证步骤中,损失在20个epoch后可以下降到0.36,之后损失曲线波动,但没有产生不利影响(图。4c).基于Swin Transformer模型的优异性能,以该模型为基准进行后续分析。

Swin Transformer模型变体调整(第二轮学习)

在进行测试以明确Swin Transformer算法的优越性能之后,我们选择了不同的Drop_path_rate、Embed_dim和depth参数设置,并将参数集标记为Swin Transformer- t、Swin Transformer- b和Swin Transformer- l变体。Drop_path是一种高效的正则化方法,当使用图像分类任务和Transformer架构时,非对称Drop_path_rate有利于监督表示学习。Embed_dim参数表示输入的红-绿-蓝(RGB)图像由阶段1中的Swin Transformer块计算后得到的图像尺寸。深度参数是四个阶段中使用的Swin Transformer块的数量。参数信息及试验结果见表1.由于阶段3中Swin Transformer块和Embed_dim参数的增加,三个变体的识别准确率分别为95.8%、96.3%和98.2%,对应的f1分数分别为96.2%、96.7%和98.3%;因此,这些变体可以以类似于CNN的方式有效提高蚊子种类的识别能力,增加卷积通道的数量,提取更多的特征,提高整体分类能力。在本研究中,Swin Transformer-L变体表现出最高的精度,被选为下一步工作的基线。

通过绘制使用三个Swin Transformer变体得到的测试集结果的混淆矩阵,我们清楚地获得了每个类别中正确和错误识别的比例,以直观地反映蚊子的物种识别能力(图2)。4d-f)。在矩阵中,对角线颜色越深,对应蚊子类别的识别率准确率越高。其中,有五种蚊子失踪Ae。vexans,Coquillettidia ochracea,Mansonia均匀化,一个。迷走神经而且巨蚊splendens数据集中的物种仅由雌性或雄性代表。图C所示的混淆矩阵列出了每个类别中蚊种识别误差点的最低数量和最低精度水平,表明Swin Transformer-L模型的分类性能优于Swin Transformer-T和Swin Transformer-B模型。

输入图像大小对辨别能力的影响(第三轮学习)

为了研究输入图像尺寸与蚊虫种类识别性能之间的关系,本研究基于Swin Transformer-L模型,对尺寸为224 × 224和384 × 384的输入图像进行了对比测试,识别出8类蚊虫种类识别精度的差异。试验结果如表所示2.当使用图像大小为224 × 224像素时,batch_size参数设置为16,当使用图像大小为384 × 384像素时,batch_size参数设置为4;在此条件下,显存利用率为67%,如式。4,这与Swin Transformer模型在使用384 × 384像素图像时,自注意操作大小之间的关系描述一致。Transformer-L模型完成所有训练会话所需的时间过多,达到了126小时,甚至超过了YOLOv5模型所需的124小时,在本工作中发现YOLOv5模型在训练过程中需要的计算时间最高。长期的训练过程可以更充分地反映模型之间的性能差异。幸运的是,模型的响应速度并不会受到训练时间的影响。基于Swin Transformer-L模型的384 × 384输入图像尺寸的蚊种识别准确率为99.04%,与224 × 224输入图像尺寸的98.2%相比,提高了0.84%。

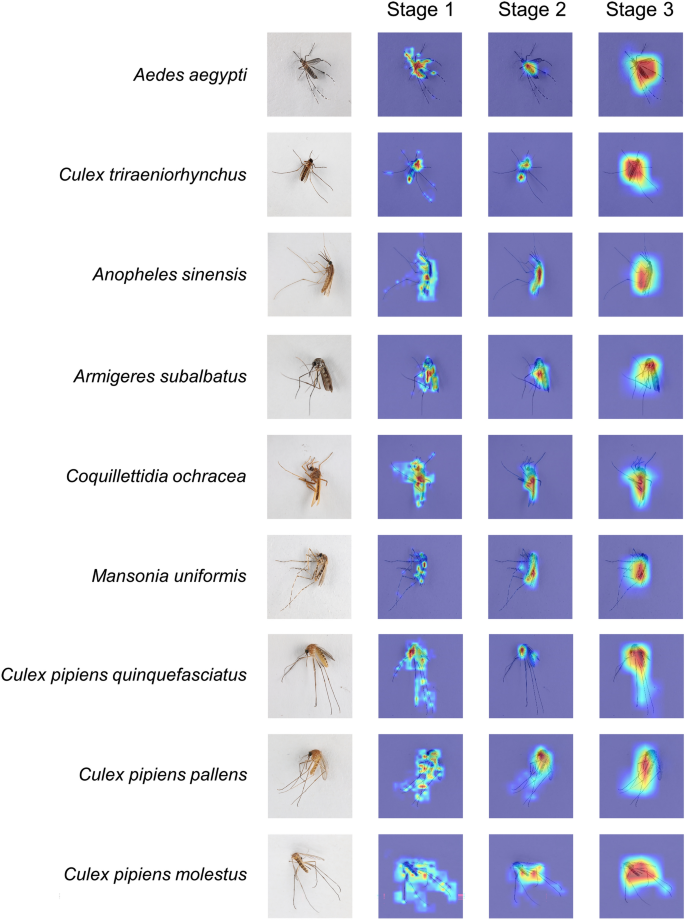

可视化和理解Swin MSI模型

为了研究Swin MSI和分类学家用于蚊子种类识别的注意特征的差异,我们应用梯度- cam方法对不同阶段的Swin MSI注意区域进行可视化。由于Swin Transformer在不同阶段的多头自注意步骤中有不同的注意范围,在不同的蚊子位置上可以发现不同的注意权重。在阶段1中,每个patch的特征维数为4 × 4 × C,使得Swin Transformer的多头自注意机制能够更多地关注蚊子的腿部、翅膀、触角和pronota等细节部位。在阶段2中,每个patch的特征维数为8 × 8 × 2C,使得Swin Transformer的多头自注意机制能够聚焦于蚊子的头部、胸部和腹部等身体。在阶段3中,当每个patch的特征维数为16 × 16 × 4C时,Swin Transformer的多头自注意机制可以聚焦蚊虫的大部分区域,从而形成每个蚊虫的全局整体注意机制(图3)。5).这种注意力集中的过程本质上与分类学家在对蚊子形态进行分类时所使用的过程相同,从细节到位置再到整个蚊子。

Ae。蚊广泛分布于全球热带和亚热带地区,可传播寨卡病毒、登革热和黄热病。本种最重要的形态识别特征是中胚层肩背两侧有一对长柄镰刀状白斑,并有一对纵条纹贯穿整个中胚层。该特征是注意力可视化中最深的部分,表明Swin MSI模型也将其视为主要的区分特征。此外,腹部的背牙龈埃及伊蚊为黑色,节段II-VII侧面有银白色斑点和基部白色条带;该模型也关注这些领域。

残雪。triraeniorhynchus是日本脑炎的主要病媒;这种蚊子的体型很小,喙上有一个独特的白色环(它最独特的形态特征),全身呈胡椒色。同样,本文所构建的模型同时关注该物种的头部和腹部区域。

一个。中国是中国疟疾的主要媒介,在其前翼缘有不超过3个白点,在其边缘V5.2边缘有一个明显的白点;这一特征在阶段2中观察到,此时模型强烈聚焦于相应的区域。

的最明显的特征骑士的扈从subalbatus是其喙部的横向扁平和略微向下弯曲;注意可视化观察表明,所构建的模型集中在阶段1到阶段3的这些区域。与长鼻相比,腹膜和腹膜不重要,对识别的重要性较小,注意力可视化结果相应地表明,神经网络对这些特征的关注较少。

Coquillettidia ochracea属于Coquillettidia属,全身金黄,腹部最明显。该模型显示该物种在腹部具有一致的形态学分类重点。

Mansonia均匀化是马来丝虫病的传播媒介。腹背为深褐色,腹节II-VII段末端带黄色,侧边有白色斑点,比吻部的深褐色特征更为明显。通过注意可视化,我们确定Swin MSI模型更关注腹部区域特征而不是长鼻特征。

蚊虫亚种级鉴定试验尖音库蚊复杂的

细粒度图像分类一直是计算机视觉领域广泛研究的焦点25,26.基于本文构建的三个亚种的测试集(包含270张图像)残雪。侵害采用Swin MSI模型时,亚种和性别鉴定准确率均为100%。

形态特征残雪。这种致倦侵害,残雪。侵害pallens,残雪。侵害molestus在残雪。侵害复合体几乎难以区分,但它们的寄主偏好、自育性、繁殖环境和停滞越冬策略都非常不同27.在现有的可用于形态分类的特征中,腹背上的条纹残雪。这种致倦侵害通常是倒三角形,与胸骨不相连,而残雪。侵害pallens矩形,与胸骨相连。残雪。侵害molestus形态上更相似吗残雪。侵害pallens作为一种生态亚种残雪。侵害复杂。然而,分类学家不建议使用上述不稳定特征作为主要的分类学特征进行分化。通过分析这三个亚种的注意可视化结果(图的最后三行)。5),我们发现的神经网络残雪。这种致倦侵害,残雪。侵害pallens,残雪。侵害molestus仍然集中在腹部区域,如暗红色所示。这些神经网络的焦点区域与人眼不同,本研究的结果表明,Swin MSI模型可以检测到这三种蚊子亚种之间肉眼无法区分的细颗粒状特征。

新型蚊子分类归因

在我们对数据集中成功识别的蚊子图像进行置信度检查后,发现最低置信度值为85%。置信度阈值越高,评价标准越严格,越能反映模型的强大性能。因此,将0.85作为判定新蚊的置信阈值。在鉴定10种未知蚊种时,最高衍生种置信度低于85%;当结果输出到属水平时(图;1d),获得正确判断的平均概率为96.26%的准确率和98.09%的F1-score(表3.).这些图像经过测试是新颖的Ae。,残雪。而且一个。蚊子来自Minakshi和Couret等人。28,29.

讨论

在Pataki等人之前的研究中。30.蚊种鉴定准确率最高,为96%;该值是基于一个公共病媒生物监测数据集(包含6195Ae。蚊图片在7686张图片中占80.6%)。在Motta等人的研究中31,该数据集包含4056张三种蚊种的成虫图像(答:蚊,埃及伊蚊,残雪。这种致倦侵害),分别使用LeNet、AlexNet和GoogleNet cnn进行构造和训练,测试结果表明,GoogleNet的准确率最高,达到76.2%。Park等人构建了包含8种蚊子3578张图像的数据集,使用VGG-16、ResNet-50和SqueezeNet实现了97%以上的分类准确率。Couret等人构建了一个包含14种蚊子的数据集,主要在属内一个。,共1709幅图像;利用该数据集,采用最佳配置的DenseNet-201模型,物种识别准确率为96.96%,性别预测准确率为98.48%。

显然,以往的蚊虫识别研究大多使用ResNet、DenseNet等经典cnn的计算机视觉技术。这项研究首次应用了最近出现的Transformer模型32用于蚊子种类鉴定。cnn通过使用堆叠的卷积层和池化层来生成不同大小的层级特征表示,并感知不同尺度的图像特征,从而完成整个训练过程。然而,CNN本身的结构设计主要关注局部特征的提取效果,往往忽略了图像中不同元素之间的联系。本研究提出的Swin MSI模型结合了Transformer模型和CNN模型的优点。所构建模型的结构与cnn的工作原理类似,通过堆叠Swin-transformer块并不断增加补丁尺寸和大小;此外,基于移动窗口的自注意机制的使用有效地减少了计算过程中产生的参数数量。通过将大小的特征图划分为大小不重叠的窗口,计算按窗口大小的平方线性,从而解决了传统Transformer模型计算复杂度高的问题。Swin MSI模型允许新斑块通过合并过程扩大大小,从而发挥与CNN中的感觉场相同的作用。在初始阶段,只能感知触角、中触须、腿或翅膀等局部特征,但在经过几个patch- merge步骤形成的大尺寸patch中,可以感知头部、胸部、腹部等全局特征,最终获得对蚊虫整体的关注。

在任何计算机视觉检测任务中,最关键的问题是人工建立图像标注(这些标注需要专业的蚊虫分类人员来执行)33,34.因此,获得一个完整而清晰的数据集进行准确的预测可以节省大量的时间和成本。除了一项关于一个。冈比亚按蚊复杂类群涉及亚种层面的分析,以往的蚊虫分类研究多集中在具有明显生物学分类学特征的种,如埃及伊蚊和白纹伊蚊.31Park等人发现,一些残缺的野外采集的蚊子阻止了神经网络捕捉关键特征,从而导致分类错误30..此外,不同蚊子种类数量的不平衡导致神经网络倾向于降低少数类别的识别质量,以最大限度地提高整体识别率35.借鉴以往经验,本研究采集的蚊虫图像包含大量关键形态特征、种类和性别细节,形成迄今为止最清晰、最均衡的专业蚊虫数据库;该数据库确保了所构建的Swin-MSI模型在蚊种识别任务中的最佳性能。

我们发现蚊子图像训练集的分辨率越高,识别效果越好。与输入图像尺寸为224 × 224相比,输入图像尺寸为384 × 384时蚊种识别准确率提高了0.84%,达到99.04%,其他相关研究结果证实了大尺寸图像输入的优越性36.目前,计算机视觉网络模型的效率受到硬件设备能力的限制。尽管我们做了一些调整,包括对模型参数数量的调整,构建的模型仍然需要在高性能硬件设备上进行大量的计算时间,例如图形处理单元(GPU)执行数据计算,中央处理单元(CPU)进行资源调用。GPU的显存决定了可以并行计算的数据量,这直接影响了训练时间。我们的蚊子数据集的分辨率为4464 × 2976像素,并考虑了图像大小的适当冗余。在未来,随着硬件计算能力的提高,以及对patch- merge过程的调整,以优化Swin MSI模型结构,将最大限度地发挥高分辨率数据集的优势,从而获得更高的精度。

在本研究中,我们试图将专业分类学家的经验与人工智能的角度相结合,以确定Swin Transformer模型是否使用了与人类专家用于分类蚊子种和亚种的形态键相似的形态键。蚊群内亚种的进化状态相似,同一蚊群内亚种的形态特征存在细微差异。不像一个。冈比亚按蚊复杂,主要分布在有限的地理区域37,残雪。侵害本研究所针对的复杂群体在世界范围内分布广泛38,其相应的吸血宿主偏好、自育过程、繁殖环境和滞冬过程均存在显著差异。由于该数据集包含完整的形态特征信息,在亚种水平上实现了100%的亚种和性别识别准确率残雪。侵害复杂。可视化结果表明,Swin MSI模型使用的形态键与人类使用的形态键相似,但不完全相同。在某些像素级细节上获得的识别特征包括蚊子的头部、胸部、腹部、背板和腿;这些特征可以作为传统分类特征的有益补充,为专业分类学家深入探讨蚊子亚种级的形态特征提供参考。

虽然本研究建立的数据集已经包括了17种蚊子(包括3个亚种),但在实际应用中,识别新蚊子的需求是普遍和不可避免的。现有Swin MSI模型的物种置信度最高低于85%,模型的正确归因概率达到96.3%。这是现有资源下的权宜之计(优先覆盖最危险和最常见的蚊子),但足以帮助缺乏经验的现场人员识别危险蚊子。通过扩大特定区域蚊虫数据集中所代表的物种数量,优化模型结构和参数,可以不断提高物种置信阈值,从而提高新蚊的归因精度。未来将为不同国家和地区推出更先进的版本,以覆盖当地的蚊子种类。Swin MSI模型可以帮助蚊子分类学家从野外生物多样性调查中确定的大量标本中快速区分出新物种39.只要训练集包含足够的识别特征,该模型对于野外采集的受损蚊子样本也具有较高的识别精度,这使得蚊子监测任务更加有效和高效40.

综上所述,本研究首次提出了基于变压器的蚊子种类识别模型。Swin MSI模型借助自行构建的高精度蚊子图像数据集,物种识别率大于99%。在不同的输入图像大小、亚种水平(蚊子的形态特征难以区分)和新物种的识别效果也进行了测试和讨论。Swin MSI模型的优异性能使其成为一种准确有效的技术工具,有助于分类学家快速识别蚊子种类,并有助于控制蚊媒疾病。

方法

伦理语句

该研究获得了北京市微生物与流行病学研究所机构动物护理使用专业委员会(IACUC-IME-2021-021)的批准。在没有伤害任何其他动物物种的情况下进行了蚊子场采样。

蚊子的数据集

在这项工作中,分类学家使用通过标准立体显微镜识别的形态指标来识别蚊子。所有蚊子都被麻醉杀死,并以自然死亡的形式拍摄了蚊子的照片。我们使用佳能光电系统(EOS) 5D Mark IV数码相机,配备老瓦100毫米F2.8微距2X镜头和匡仁KR-888微距闪光灯,构建了蚊子图像的微距摄影平台,捕捉每只蚊子的背部、腹部、左侧和右侧,覆盖关键识别特征。每只蚊子都拍了三到五张照片。相机和闪光灯参数设置为ISO400,快门速度设置为1/100秒,光圈设置为22,闪光指数设置为1/16。

数据划分、预处理和增强步骤

使用LabelImg软件对捕获的蚊子图像进行标记,生成包含类别、性别和位置坐标信息的txt文件。根据雌雄各占一半的原则(由于雌雄识别特征不同,每个物种包括300张雌雄图像),共捕获了17个物种(和3个亚种)的9900张图像。如果样本中缺少一种性别,从该物种中提取的蚊子数量就会减半)。图像被随机划分为训练集、验证集和测试集,分别包含6930张(70%)、1485张(15%)和1485张(15%)图像。为了防止欠拟合,降低过拟合的概率,并防止由于类别份额不平衡而导致的分类失衡,我们应用了24次旋转,每15度增加一次,通过使用旋转、翻转和调整大小的方法来大幅增加训练图像集的大小和多样性。

CNN模型与变压器模型试验结果的比较

首先选择6个计算机视觉模型(Mask R-CNN, DenseNet, YOLOv5, Swin Transformer, Detection Transformer和vision Transformer模型)进行测试(表2)4)22,23,24,41,42.Mask R-CNN模型使用特征金字塔网络(FPN)架构来增强其多尺度特征提取能力41.DenseNet通过建立不同层之间的连接,进一步缓解了梯度消失问题42.YOLOv5超越了以前的各种版本的YOLO模型,具有少量参数和强大的快速部署优势。Detection Transformer使用CNN提取特征,然后使用变压器进行识别,真正实现了少先验的端到端检测。Dosovitskiy提出了一种纯转换器,即视觉转换器(Vision transformer, ViT)来序列化图像,并将其应用于图像分类任务,取得了良好的效果。Swin Transformer使用滑动窗口,并引入了类似于cnn中使用的扩展感知场的概念。以上6个模型是cnn和变压器的优秀代表,在各种应用场景下分析ImageNet等数据集时都达到了较高的精度。

MSI模型设计

通过对上述6个模型的筛选,我们发现Swin Transformer算法模型在第一个测试阶段性能最好,最终选择Swin Transformer算法模型进行进一步分析。进一步调整参数配置,测试变量(T, B和L)和输入图像尺寸(384 × 384和224 × 224)对物种识别精度的影响。具体步骤将在下一节中进一步解释。

Swin MSI框架

Swin MSI模型使用补丁分裂模型将预处理过的蚊子图像分割成许多不重叠的补丁。补丁数量为\(\frac{H}{4} \times \frac{W}{4}\),将每个patch视为一个尺寸为4 × 4的令牌,将每个patch的特征设置为预处理后蚊虫图像中的一系列像素值;因此,每个patch中的特征数量为4 × 4 × 3 = 48。然后将线性嵌入层应用于分割的补丁,将其投影到设置的尺寸(C)。

将阶段1的计算结果与2 × 2个相似大小的patch合并,将patch的大小增加到8 × 8, patch的数量为\(\frac{H}{8} \times \frac{W}{8}\);然后将这些补丁作为阶段2的输入。重复Swin Transformer块的自注意计算后,得到阶段2的输出,并分两阶段(记为阶段3和阶段4)继续计算,直到patch大小达到32 × 32。此时补丁数量为\(\frac{H}{32} \times \frac{W}{32}\), 8C的尺寸。在移动窗口的过程中,每次都会移动一半的补丁,以确保在这个过程中没有丢失任何特性。在这项工作中,输入图像大小设置为224 × 224和384 × 384像素,每个窗口使用的最终补丁号设置为7 × 7和12 × 12。

移窗多头自注意

Swin Transformer模块由两个连续的Swin Transformer模块组成:具有常规窗口配置(W-MSA)和移动窗口配置(SW-MSA)的多头自关注模块。一个层归一化处理模块(LN()),一个多层感知器(MLP ()), SW-MSA模块(\(\mathop {Z^{L}}\limits^{\wedge}\)),以及MLP特征的输出特征(\ (Z ^ {L} \))亦成立。

连续Swin变压器块中的计算可以用式(1),详情如下:

非重叠窗口X导出的SW-MSA模块可表示为式(2),详情如下:

使用查询(Q)、键(K)和值(V)计算窗口上的多头自注意。在此过程中,使用可学习的相对位置对B进行编码;这个特征可以用式表示(3.),详情如下:

对于Swin Transformer,将该多头自注意特征计算n次(即网络中不同阶段使用的Swin Transformer block的数量),然后进行拼接,得到最终的多头自注意结果。

新型蚊虫分类的Swin MSI模型

在现实环境中,识别新蚊子的需求是普遍和不可避免的。未纳入本数据集(包括17种3亚种)的蚊种在此定义为新种。当Swin MSI模型成功分析蚊子图像时,输出一个大小为[m, n]的矩阵为C,其中m为蚊子图像的数量,n为处理过程中使用的类别数量。此时,对行向量进行softmax归一化,得到目标图像中每个类别的置信度,并将此信息用于物种分类过程。通过确定本研究中准确识别出蚊种的蚊虫图像,可以检验出最小置信水平,并将其作为新物种检测所需的置信阈值;如果待识别图像的最高物种置信度大于该阈值,则可以输出物种级信息;如果最高物种置信水平低于该阈值,则可以获得属级信息。

Swin MSI模型使用的形态键的识别

使用梯度加权类激活映射(Grad-CAM)43,我们可视化并识别了每张图像中可以解释Swin MSI模型获得的最终分类结果的区域。首先,对网络进行正向传播,得到特征层A(在本工作中,“特征层A”指的是每个阶段的输出)和网络预测y。假设网络对给定蚊子图片的分类预测为yc,反向传播步骤可以提供梯度信息A',然后将梯度信息反向传播到特征层A。通过计算特征层A中每个通道的重要度,加权和,并进行整流线性单元(ReLu)计算,最终得到梯度- cam。然后将注意力可视化步骤中获得的感兴趣区域与蚊子分类学家感兴趣的形态分类特征进行比较,以探索Swin Transformer模型是否使用了与人类专家用于分类蚊子物种的形态键相似的形态键。

评价方法

我们在每个实验中报告了准确率(acc)和f1-score(f1), acc可定义为:

F1可以表述为:

其中,precision和recall可以定义为:

其中TP为真阳性样本数,TN为真阴性样本数,FP为假阳性样本数,FN为假阴性样本数。

数据可用性

在当前研究中使用和分析的数据集可根据合理要求从通讯作者处获得。

代码的可用性

我们利用Github存储库进行Mask R-CNN, DenseNet, YOLOv5, Detection Transformer, Vision Transformer和Swin Transformer实现。Swin MSi的代码可以通过GitHub存储库公开获取:https://github.com/zdz0086/Swin-msi.所有这些都是开源的,可以公开使用。

参考文献

谁。媒介传播疾病.https://www.who.int/news-room/fact-sheets/detail/vector-borne-diseases.(2020)。

阿什利,E. A.,皮厄菲欧,A. &伍德罗,C. J.疟疾。《柳叶刀》391, 1608-1621(2018)。

马蒂娜,B. E. E., Koraka, P. & Osterhaus, A. D. M. E.登革热病毒发病机制:综合观点。中国。Microbiol。牧师。22, 564-581(2009)。

单春,谢晓霞,施培义。寨卡病毒疫苗:进展与挑战。细胞宿主微生物24, 12-17(2018)。

Silva, l.a. & Dermody, T. S.基孔肯雅病毒:流行病学、复制、疾病机制和前瞻性干预策略。j .中国。投资。127, 737-749(2017)。

彼得森,L. R.,布劳,A. C.和纳斯奇,R. S.西尼罗河病毒:文献综述。《美国医学会杂志》310, 308-315(2013)。

沙玛,K. B., Vrati, S. & Kalia, M.日本脑炎病毒感染的病理生物学。Mol. Aspects Med。81, 100994(2021)。

Taylor, M. J., Hoerauf, A. & Bockarie, M.淋巴丝虫病和盘尾丝虫病。《柳叶刀》376, 1175-1185(2010)。

辛卡,m.e。et al。占主导地位的按蚊亚太地区人类疟疾病媒:发生数据、分布图和生物经济概况。寄生虫向量4, 89(2011)。

琼斯,R. T., Ant, T. H., Cameron, M. M. & Logan, J. G.蚊媒疾病的新控制策略。费罗斯。反式。r . Soc。B。376, 20190802(2021)。

控制蚊媒感染的挑战和机遇。自然559, 490-497(2018)。

植物的系统发育和分类按蚊.在按蚊(Manguin, S.) (IntechOpen, 2013)。

Hebert, P. D., Cywinska, A., Ball, S. L. & deWaard, J. R.通过DNA条形码进行生物识别。Proc,杂志。科学。270, 313-321(2003)。

高,Q。et al。结构、时空分布尖音库蚊公司位于中国上海。Int。j .包围。公共卫生决议案13, 1150(2016)。

赵涛,陆波。生物系统学尖音库蚊复杂的中国。昆虫科学。2, 1-8(1995)。

吕坤,李志强,李志强。基于梯度的学习在文档识别中的应用。Proc。IEEE86, 2278-2324(1998)。

Krizhevsky, A., Sutskever, I. & Hinton, g.e. ImageNet分类与深度卷积神经网络。在神经信息处理系统(2012).

Szegedy C。等.深入研究卷积。在IEEE计算机视觉与模式识别会议(CVPR)(2015)。

西蒙尼扬,K.;用于大规模图像识别的超深度卷积网络n。arXiv: 1409.1556(2014)。

何凯明,张晓燕,任世强,孙杰。基于深度残差学习的图像识别。在IEEE计算机视觉与模式识别会议(CVPR)(2016)。

伊安多拉,f。等.SqueezeNet: alexnet级精度,参数少50倍,模型大小< 0.5MB。arXiv: 1602.07360(2016)。

Carion, N。等.使用变压器的端到端对象检测.arXiv: 2005.12872(2020)。

Dosovitskiy,。等.一幅图像值16x16字:变形金刚的图像识别规模.v2 arXiv: 2010.11929(2021)。

刘,Z。等.Swin Transformer:使用移位窗口的分层视觉转换器.arXiv: 2103.14030(2021)。

林,T.-Y。,RoyChowdhury, A. & Maji, S. Bilinear CNN models for fine-grained visual recognition. In2015年IEEE计算机视觉国际会议(ICCV)(2015)。

Hariharan, B, Arbeláez, P., Girshick, R. & Malik, J.用于对象分割和细粒度定位的超列。在2015年IEEE计算机视觉与模式识别会议(CVPR)(2015)。

哈巴克,r.e.。尖音库蚊:物种与物种复合分类学的历史与展望。j。Mosq。控制协会。28, 10-23(2012)。

Minakshi, M., Bharti, P., Bhuiyan, T., Kariev, S. & Chellappan, S.一个基于深度神经网络从图像中提取蚊子解剖结构的框架。科学。代表。10, 13059(2020)。

Couret, J。et al。使用卷积神经网络划分人类疟疾病媒物种之间的隐性形态变异。公共科学图书馆Negl。太。说。14, e0008904(2020)。

Park, J, Kim, D. I., Choi, B., Kang, W. & Kwon, H. W.利用深度卷积神经网络对病媒蚊子的分类和形态分析。科学。代表。10, 1012(2020)。

莫塔,D。et al。卷积神经网络在成蚊野外分类中的应用。《公共科学图书馆•综合》14, e0210829(2019)。

Vaswani)。等.你只需要关注.arXiv: 1706.03762(2017)。

邓,J。等.ImageNet:一个大规模的分层图像数据库。在ieee计算机学会计算机视觉和模式识别研讨会(2009)。

林,T.-Y。等.Microsoft COCO:上下文中的通用对象.arXiv: 1405.0312(2015)。

Buda, M., Maki, A. & Mazurowski, M. A.对卷积神经网络中类不平衡问题的系统研究。神经。106, 249-259(2018)。

Valan, M., Makonyi, K., Maki, A., Vondracek, D. & Ronquist, F.使用卷积网络的有效特征转移对昆虫进行专家级精度的自动分类识别。系统。医学杂志。68, 876-895(2019)。

霍尔特,r.a。et al。疟疾蚊子的基因组序列冈比亚疟蚊.科学298, 129-149(2002)。

冯塞卡博士et al。出现的病媒尖音库蚊复杂。科学303, 1535-1538(2004)。

Høye, T. T。et al。深度学习和计算机视觉将改变昆虫学。《美国国家科学院学报》上。118(2), e2002545117(2020)。

Kittichai, V。et al。挑战蚊媒物种和性别识别的深度学习方法。科学。代表。11, 4838(2021)。

他,K., Gkioxari, G., Dollar, P. & Girshick, R. Mask R-CNN。:第16届IEEE计算机视觉国际会议(ICCV)(2017)。

黄国强,刘泽,范德玛滕,L.和温伯格,K. Q.密集连接卷积网络。在第30届IEEE/CVF计算机视觉和模式识别会议(CVPR)(2017)。

塞尔瓦拉朱,R。R。等.Grad-CAM:基于梯度定位的深度网络视觉解释.arXiv: 1610.02391(2016)。

作者信息

作者及隶属关系

贡献

C.L.和g.c., F.S.构想,设计并监督了整个研究。d.z., X.W.和T.Z.负责文章的初稿。D.Z.开发了基于transformer的蚊子种类识别模型。X.W.建立了蚊子图像数据库。T.Z.负责撰写、审稿和编辑。h.l.、d.x.和H.G.负责资源、可视化和项目管理。

相应的作者

道德声明

相互竞争的利益

作者声明没有利益竞争。

额外的信息

出版商的注意

施普林格自然对出版的地图和机构从属关系中的管辖权主张保持中立。

权利和权限

开放获取本文遵循知识共享署名4.0国际许可协议,允许以任何媒介或格式使用、分享、改编、分发和复制,只要您对原作者和来源给予适当的署名,提供知识共享许可协议的链接,并注明是否有更改。本文中的图像或其他第三方材料包含在文章的创作共用许可协议中,除非在材料的信用额度中另有说明。如果材料未包含在文章的创作共用许可协议中,并且您的预期使用不被法定法规所允许或超出了允许的使用范围,您将需要直接获得版权所有者的许可。如欲查看本牌照的副本,请浏览http://creativecommons.org/licenses/by/4.0/.

关于本文

引用本文

赵,Dz。,Wang, Xk., Zhao, T.et al。基于Swin transformer的蚊虫种类识别模型。Sci代表12, 18664(2022)。https://doi.org/10.1038/s41598-022-21017-6

收到了:

接受:

发表:

DOI:https://doi.org/10.1038/s41598-022-21017-6