通过使用大量数据来识别照片和语音,深度学习计算机向真正的人工智能迈出了一大步。

三年前,位于加州山景城的秘密谷歌X实验室的研究人员从YouTube视频中提取了大约1000万张静态图像,并将它们输入谷歌大脑——一个由1000台计算机组成的网络,可以像人类蹒跚学步的孩子一样吸收世界。在寻找重复模式三天后,谷歌Brain自己决定,它可以识别某些重复类别:人脸、人体和……猫1。

Brain发现网上到处都是猫的视频,这引起了记者们的一阵玩笑。但它也是深度学习复兴的一个里程碑:这是一项已有30年历史的技术,大量数据和处理能力帮助计算机解决人类几乎凭直觉解决的混乱问题,从识别面孔到理解语言。

深度学习本身是一个更古老的计算思想的复兴:神经网络。这些系统的灵感来自于大脑中紧密相连的神经元,通过在经验的基础上改变模拟神经连接的强度来模拟人类的学习。谷歌Brain拥有大约100万个模拟神经元和10亿个模拟连接,比之前的任何深度神经网络都要大10倍。项目创始人吴恩达(Andrew Ng)现在是加州斯坦福大学(Stanford University)人工智能实验室(Artificial Intelligence Laboratory)的主任,他继续将深度学习系统的规模扩大了10倍。

这些进步为人工智能(AI)带来了激动人心的时刻——让计算机像人类一样思考的尝试往往令人沮丧。在过去几年里,谷歌、苹果(Apple)和IBM等公司一直在积极收购拥有深度学习专业知识的初创公司和研究人员。对于日常消费者来说,其结果包括软件能够更好地对照片进行分类、理解语音命令以及翻译外语文本。对于科学家和工业界来说,深度学习计算机可以搜索潜在的候选药物,绘制大脑中的真实神经网络或预测蛋白质的功能。

“人工智能已经从失败走向失败,取得了一些进展。这可能是另一个跨越,”纽约大学(New York University)数据科学中心主任、深度学习先驱扬·勒丘恩(Yann LeCun)说。

“在接下来的几年里,我们将看到一场疯狂的捕食。很多人会加入深度学习的大潮,”加州大学伯克利分校(University of California, Berkeley)研究计算机图像识别的Jitendra Malik表示赞同。但从长远来看,深度学习可能不会赢得胜利;一些研究人员正在寻求其他有希望的技术。“我是不可知论者,”马利克说。“随着时间的推移,人们会决定在不同的领域什么是最好的。”

灵感来自大脑

早在20世纪50年代,当计算机还是新事物时,第一代人工智能研究人员就热切地预测,成熟的人工智能即将到来。但是,当研究人员开始掌握现实世界知识的巨大复杂性时,这种乐观情绪就消失了,特别是当涉及到感知问题时,比如什么使一张脸成为一张人脸,而不是一张面具或猴子的脸。数百名研究人员和研究生花了几十年时间,手工编写了计算机识别物体所需的所有不同特征的规则。吴恩达表示:“开发新功能非常困难、耗时,还需要专业知识。“你得问问有没有更好的办法。”

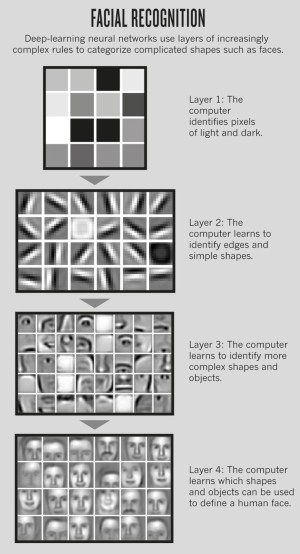

在20世纪80年代,一种更好的方法似乎是神经网络中的深度学习。这些系统承诺从零开始学习自己的规则,并提供了使用受大脑启发的机制来实现类大脑功能的令人愉悦的对称性。该策略要求模拟神经元被组织成几层。给这样一个系统一张图片,第一层学习就会简单地注意到所有的暗像素和亮像素。下一层可能会意识到这些像素中的一些形成了边缘;接下来可能会区分水平线和垂直线。最终,一个层可能会识别眼睛,并且可能会意识到在人脸中通常有两只眼睛(参见“面部识别”)。

马利克说,第一个深度学习程序并不比更简单的系统表现更好。另外,他们很难相处。“神经网络一直是一门微妙的艺术。这里面有一些黑魔法,”他说。网络需要大量的例子来学习,就像婴儿收集世界信息一样。在20世纪80年代和90年代,可用的数字信息并不多,计算机要花很长时间才能处理现有的信息。申请很少。为数不多的技术之一是LeCun开发的一种技术,现在被银行用来读取手写支票。

然而,到了21世纪,像LeCun和他的前导师、加拿大多伦多大学的计算机科学家杰弗里·辛顿(Geoffrey Hinton)这样的倡导者相信,计算能力的增强和数字数据的爆炸式增长意味着是时候重新推动了。欣顿目前的学生乔治·达尔(George Dahl)说:“我们想向世界展示,这些深度神经网络真的很有用,真的有帮助。”

首先,辛顿、达尔和其他几个人解决了语音识别这一困难但具有重要商业意义的任务。2009年,研究人员报告说2在对经典数据集(三个小时的录音和转录演讲)进行训练后,他们的深度学习神经网络在将口语转化为打字文本方面打破了记录,这一记录在过去十年里用标准的、基于规则的方法没有太大变化。达尔说,这一成就引起了智能手机市场主要参与者的注意,他在微软实习期间把这项技术带到了微软。“几年后,他们都转向了深度学习。”例如,iPhone的声控数字助手Siri就依赖于深度学习。

巨大的飞跃

谷歌在其Android智能手机操作系统中采用基于深度学习的语音识别技术后,错字率降低了25%。辛顿说:“这种降幅你预计要花10年才能达到。”这反映出在这一领域取得进展是多么困难。“这就像十项突破加在一起。”

与此同时,吴恩达说服谷歌允许他使用该公司的数据和计算机,开发后来的谷歌Brain。该项目发现猫的能力是无监督学习的一个引人注目的(但本身不具有商业可行性)演示,无监督学习是最困难的学习任务,因为输入没有任何解释性信息,如名字、头衔或类别。但吴恩达很快就遇到了麻烦,因为谷歌之外的研究人员很少有研究深度学习的工具。“在我讲了很多次之后,”他说,“抑郁的研究生会来找我说:‘我没有1000台电脑,我还能研究这个吗?’”

所以回到斯坦福大学,吴恩达开始使用图形处理单元(gpu)开发更大、更便宜的深度学习网络——gpu是为家用电脑游戏开发的超快芯片3.。其他人也在做同样的事情。吴恩达说:“用大约10万美元的硬件,我们可以用64个gpu建立一个110亿连接的网络。”

胜利的机

但是要赢得计算机视觉科学家的支持需要付出更多的努力:他们希望在标准化测试中有所收获。马利克记得辛顿问他:“你是个怀疑论者。什么能让你信服?”马利克回答说,在国际知名的ImageNet比赛中获胜可能会达到目的。

在这场比赛中,参赛队伍用大约100万张图片的数据集训练计算机程序,每张图片都被手动贴上了一个类别的标签。训练结束后,对程序进行测试,让它们为以前从未见过的相似图像建议标签。每个测试图像给他们五次猜测;如果正确答案不是这五个中的一个,测试将被视为错误。过去的赢家通常有25%的时间是错误的。2012年,Hinton的实验室参加了有史以来第一个使用深度学习的竞争对手的比赛。它的错误率只有15%(参考文献。4).

“深度学习践踏了其他一切,”LeCun说,他不是那个团队的一员。这次获奖让欣顿在谷歌找到了一份兼职工作,该公司在2013年5月利用该项目更新了谷歌+照片搜索软件。

马利克被说服了。“在科学领域,你必须受到经验证据的影响,而这是明确的证据,”他说。从那以后,他利用这项技术在另一场视觉识别比赛中打破了纪录5。许多人也纷纷效仿:2013年,所有参加ImageNet竞赛的参赛者都使用了深度学习。

在接下来的几年里,我们将看到一场疯狂的进食。很多人会加入深度学习的潮流。

随着图像和语音识别的胜利,现在人们越来越有兴趣将深度学习应用于自然语言理解——例如,充分理解人类话语,以重新表达或回答问题——以及从一种语言翻译到另一种语言。同样,这些目前是使用手工编码的规则和对已知文本的统计分析来完成的。在谷歌Translate等软件中可以看到这种技术的最先进水平,它可以生成易于理解的结果(如果有时是滑稽的),但远不及流畅的人工翻译。众包专家路易斯·冯·安(Luis von Ahn)说:“深度学习将有机会比目前的做法做得更好。”他的多邻国(Duolingo)公司位于宾夕法尼亚州的匹兹堡,主要依靠人类而不是电脑来翻译文本。“每个人都同意的一点是,是时候尝试一些不同的东西了。”

深刻的科学

与此同时,深度学习已被证明对各种科学任务有用。辛顿说:“深度网络非常擅长在数据集中发现模式。”2012年,制药公司默克(Merck)为帮助预测有用候选药物的最佳程序提供奖励。这项任务是在数据库中搜索30,000多个小分子的条目,每个小分子都有数千个数值化学性质描述符,并试图预测每个小分子如何作用于15个不同的目标分子。达尔和他的同事凭借深度学习系统赢得了2.2万美元的奖金。他说:“我们在默克公司的基础上提高了大约15%。”

生物学家和包括剑桥麻省理工学院Sebastian Seung在内的计算研究人员正在使用深度学习来帮助他们分析大脑切片的三维图像。这样的图像包含了一团代表神经元之间连接的线;这些需要被识别出来,这样才能进行映射和统计。在过去,大学生们被招募来追踪这些线路,但随着此类项目的继续,处理预计将出现的数十亿个连接的唯一方法是将这一过程自动化。深度学习似乎是自动化的最佳方式。Seung目前正在使用一种深度学习程序来绘制视网膜的一大块神经元,然后将结果转发给一个名为EyeWire的众包在线游戏中的志愿者进行校对。

深度学习有一个特性,如果你给它提供更多的数据,它会变得越来越好。

西雅图华盛顿大学的计算机科学家威廉·斯塔福德·诺布尔(William Stafford Noble)已经利用深度学习教一个程序观察一串氨基酸,并预测产生的蛋白质的结构——例如,不同的部分是否会形成螺旋或环,或者溶剂是否容易潜入结构的间隙。到目前为止,Noble已经在一个小数据集上训练了他的程序,在接下来的几个月里,他将转移到蛋白质数据库:一个目前包含近10万个结构的全球存储库。

对于计算机科学家来说,深度学习可以赚取巨额利润:达尔正在考虑创业机会,LeCun上个月被聘为Facebook新成立的人工智能部门的负责人。这项技术有望为人工智能带来实际成功。吴恩达指出:“深度学习有一个特性,如果你给它提供更多的数据,它就会变得越来越好。”“深度学习算法并不是唯一这样的算法,但它们可以说是最好的——当然也是最简单的。这就是为什么它对未来有巨大的希望。”

并不是所有的研究人员都认同这一观点。西雅图艾伦人工智能研究所(Allen Institute for Artificial Intelligence)所长奥伦•埃齐奥尼(Oren Etzioni)表示,他不会利用大脑来寻找灵感。该研究所于去年9月成立,旨在开发人工智能。“这就像我们发明飞行一样,”他说;最成功的飞机设计并非以鸟类生物学为蓝本。Etzioni的具体目标是发明一种电脑,只要给它一堆扫描的教科书,它就能通过标准化的小学科学考试(最终提高到大学预科考试)。为了通过测试,计算机必须能够阅读和理解图表和文本。艾伦研究所将如何实现这一目标还没有决定,但对Etzioni来说,神经网络和深度学习并不是最重要的。

一种与之竞争的想法是,依靠一台可以根据输入的事实进行推理的计算机,而不是试图从头开始学习自己的事实。因此,它可能会被植入诸如“所有女孩都是人”之类的断言。然后,当出现提到一个女孩的文本时,计算机可以推断出这个女孩是一个人。即使没有数百万,也需要成千上万这样的事实,才能涵盖关于世界的普通常识。不过,IBM的沃森(Watson)电脑也差不多采用了这种方法,沃森赢得了电视游戏节目的一场比赛危险在2011年与顶级人类竞争对手的比赛中。即便如此,IBM的沃森解决方案公司(Watson Solutions)仍对深度学习提高模式识别有实验兴趣,该公司首席技术官罗布•海(Rob High)表示。该公司位于德克萨斯州奥斯汀。

谷歌也在两面下注。尽管它在图片标记方面的最新进展是基于Hinton的深度学习网络,但它还有其他部门,职权范围更广。2012年12月,微软聘请了未来学家雷·库兹韦尔(Ray Kurzweil)来研究各种让计算机从经验中学习的方法——使用包括但不限于深度学习在内的技术。去年5月,谷歌收购了一台由加拿大burnnaby的D-Wave公司制造的量子计算机自然498, 286 - 288;2013)。这台计算机有望完成非人工智能任务,例如困难的数学计算——尽管从理论上讲,它可以应用于深度学习。

尽管取得了成功,但深度学习仍处于起步阶段。“这是未来的一部分,”达尔说。“在某种程度上,我们用这么少的钱做了这么多的事情,这是令人惊讶的。”而且,他补充道:“我们才刚刚开始。”

参考文献

Le, Q. V.等。预印在http://arxiv.org/abs/1112.6209(2011)。

穆罕默德,A.等人。2011 IEEE Int。声学语音信号处理。http://dx.doi.org/10.1109/ICASSP.2011.5947494(2011)。

科茨等人。机器学习。车间会议决议28, 1337-1345(2013)。

Krizhevsky, A., Sutskever, I. &辛顿,g.e.in神经信息处理系统研究进展;可以在http://go.nature.com/ibace6

格什克,R.,多纳休,J.,达雷尔,T.;马利克,J.预印本在http://arxiv.org/abs/1311.2524(2013)。

作者信息

作者及隶属关系

相关链接

权利和权限

关于本文

引用本文

琼斯。N.计算机科学:学习机器。自然505, 146-148(2014)。https://doi.org/10.1038/505146a

发表:

发行日期:

DOI:https://doi.org/10.1038/505146a

这篇文章被引用

E-Tanh:一种用于图像处理神经网络模型的新激活函数

神经计算及应用(2022)

Wie funktioniert maschinelles leren ?

Der Radiologe(2020)